- BERT (Bidirectional Encoder Representations from Transformers) là thuật toán xử lý ngôn ngữ tự nhiên của Google.

- Mục tiêu chính của BERT là cải thiện khả năng hiểu ngữ cảnh và ý nghĩa thực sự của truy vấn tìm kiếm.

- Hoạt động dựa trên mô hình hai chiều và kiến trúc Transformer, qua quá trình tiền huấn luyện và tinh chỉnh.

- BERT ảnh hưởng đến SEO bằng cách ưu tiên nội dung tự nhiên, toàn diện, đáp ứng sâu sắc ý định tìm kiếm.

- Tối ưu nội dung cho BERT tập trung vào chất lượng, tính mạch lạc, sử dụng thực thể và cải thiện trải nghiệm người dùng.

- BERT không phải yếu tố xếp hạng trực tiếp mà là công cụ giúp Google đánh giá mức độ liên quan của nội dung.

Sau khi đã nắm được tổng quan về Google BERT, chúng ta sẽ đi sâu hơn vào định nghĩa, cơ chế hoạt động, và những tác động cụ thể của thuật toán này đối với kết quả tìm kiếm Google cũng như chiến lược SEO. LADIGI Agency sẽ phân tích chi tiết cách BERT thay đổi cách Google hiểu ngôn ngữ và cách bạn có thể tối ưu nội dung để phù hợp.

Google BERT là gì?

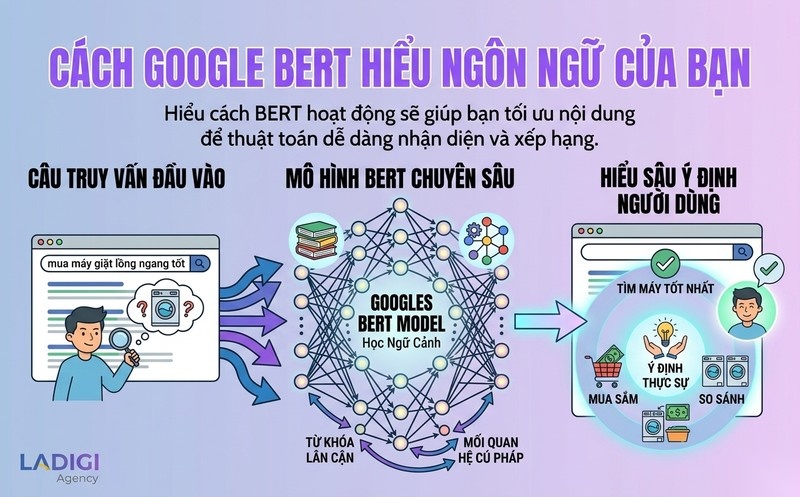

Google BERT (Bidirectional Encoder Representations from Transformers) là một thuật toán xử lý ngôn ngữ tự nhiên (NLP) dựa trên mạng nơ-ron được Google giới thiệu vào tháng 10 năm 2019. Mục tiêu chính của BERT là giúp công cụ tìm kiếm hiểu ý nghĩa và ngữ cảnh của từ ngữ trong một truy vấn hoặc nội dung một cách tốt hơn, từ đó cung cấp các kết quả tìm kiếm liên quan và chính xác hơn cho người dùng.

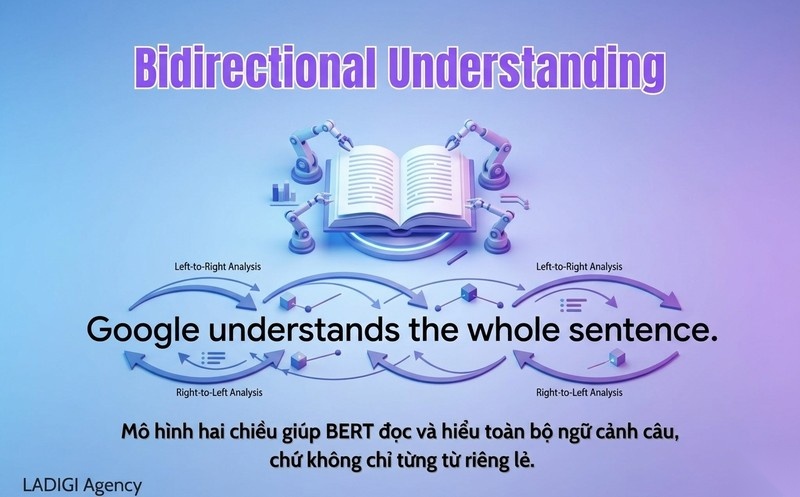

BERT là một mô hình mã hóa hai chiều từ kiến trúc Transformer. Điều này có nghĩa là nó không chỉ phân tích mối quan hệ giữa các từ theo một chiều (từ trái sang phải hoặc từ phải sang trái) mà còn xử lý đồng thời cả hai chiều. Khả năng này cho phép BERT nắm bắt được ngữ cảnh đầy đủ của mỗi từ trong một câu, bao gồm cả các từ nối, giới từ vốn thường bị bỏ qua trong các thuật toán trước đây.

Vai trò cốt lõi của BERT trong Google Search là cải thiện khả năng hiểu các truy vấn tìm kiếm bằng ngôn ngữ tự nhiên, đặc biệt là những truy vấn dài, phức tạp hoặc có chứa các từ khóa đa nghĩa. Bằng cách hiểu rõ hơn ý định thực sự của người dùng, BERT giúp Google khớp các truy vấn đó với các trang web có nội dung liên quan nhất, mang lại trải nghiệm tìm kiếm hiệu quả hơn cho hàng tỷ người dùng toàn cầu. Đây được đánh giá là một trong những thay đổi quan trọng nhất đối với hệ thống tìm kiếm của Google trong nhiều năm.

Tại sao Google phát triển thuật toán BERT?

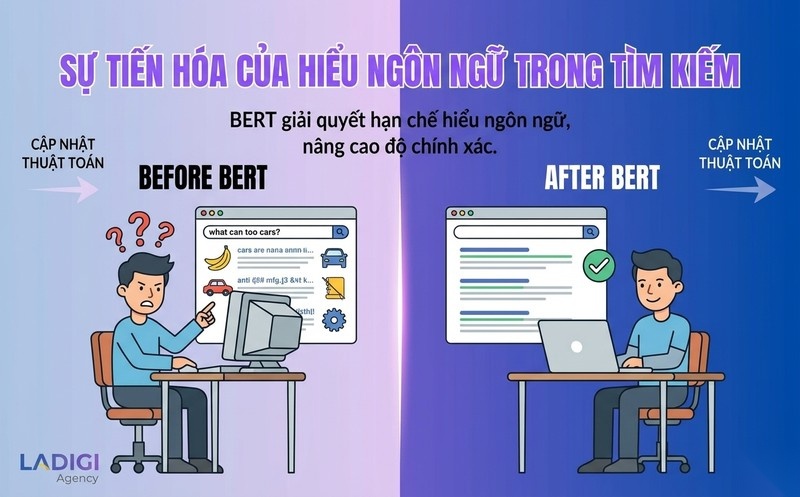

Google phát triển thuật toán BERT nhằm giải quyết những hạn chế cố hữu trong khả năng hiểu ngôn ngữ tự nhiên của công cụ tìm kiếm, đặc biệt là đối với các truy vấn dài, phức tạp và đòi hỏi sự tinh tế trong ngữ cảnh. Các thuật toán tìm kiếm trước đây thường gặp khó khăn trong việc nắm bắt ý nghĩa sâu sắc của các câu hỏi mang tính đàm thoại.

Hạn chế trong khả năng hiểu ngôn ngữ trước BERT

Trước khi BERT ra đời, các thuật toán của Google thường xử lý truy vấn bằng cách tập trung vào các từ khóa chính, đồng thời bỏ qua hoặc đánh giá thấp vai trò của các từ nối và giới từ (như “từ”, “cho”, “với”, “không”). Những từ này thường được coi là “stop words” và ít được quan tâm. Hạn chế này dẫn đến việc Google có thể hiểu sai ý định của người dùng, làm giảm độ chính xác của kết quả tìm kiếm.

Ví dụ, truy vấn “cần visa đi Mỹ từ Việt Nam” có thể bị các thuật toán cũ hiểu nhầm thành “cần visa Mỹ ở Việt Nam” nếu bỏ qua từ “từ”. Điều này làm thay đổi hoàn toàn ý nghĩa và dẫn đến việc hiển thị các kết quả không chính xác hoặc không liên quan đến nhu cầu ban đầu của người dùng là tìm kiếm thông tin về quy trình xin visa từ Việt Nam đến Mỹ. Việc thiếu đi khả năng hiểu ngữ cảnh đã tạo ra một khoảng trống lớn trong khả năng cung cấp thông tin hữu ích của công cụ tìm kiếm.

Nhu cầu giải quyết các truy vấn phức tạp

Với sự phát triển của công nghệ và thói quen sử dụng, người dùng ngày càng có xu hướng tìm kiếm thông tin bằng ngôn ngữ tự nhiên, sử dụng các câu hỏi dài và phức tạp hơn thay vì chỉ gõ những từ khóa ngắn gọn. Đây là một thách thức lớn đối với các mô hình tìm kiếm truyền thống, vốn không đủ mạnh để xử lý sự phức tạp và sắc thái của ngôn ngữ đàm thoại.

Google nhận thấy nhu cầu cấp thiết trong việc cải thiện khả năng hiểu các truy vấn này để đáp ứng kỳ vọng ngày càng cao của người dùng. Mục tiêu là cung cấp khả năng hiểu sâu sắc hơn về ý định đằng sau những truy vấn phức tạp, giúp Google đưa ra những câu trả lời chính xác và hữu ích hơn, giống như một cuộc trò chuyện với người thật. BERT ra đời nhằm lấp đầy khoảng trống này, cho phép Google xử lý các cụm từ phức tạp với độ chính xác cao hơn, qua đó nâng cao chất lượng tổng thể của kết quả tìm kiếm.

Mục tiêu nâng cao độ chính xác kết quả tìm kiếm

Mục tiêu tối thượng của Google luôn là cung cấp cho người dùng những kết quả tìm kiếm hữu ích và chính xác nhất có thể. Các thuật toán trước đây, dù hiệu quả ở một mức độ nhất định, vẫn còn những hạn chế khi đối mặt với sự phức tạp và đa dạng của ngôn ngữ tự nhiên. BERT được phát triển để khắc phục những hạn chế này, đóng vai trò quan trọng trong việc nâng cao độ chính xác của kết quả tìm kiếm.

Bằng cách hiểu ngữ cảnh toàn diện của các từ trong một truy vấn, BERT giúp Google lựa chọn và xếp hạng các tài liệu liên quan một cách chính xác hơn. Điều này không chỉ có nghĩa là hiển thị các trang chứa từ khóa mà còn đảm bảo rằng các trang đó thực sự giải quyết được ý định và câu hỏi tiềm ẩn của người dùng. Kết quả là người dùng nhận được câu trả lời tốt hơn, ít phải tinh chỉnh lại truy vấn, từ đó nâng cao trải nghiệm tìm kiếm tổng thể và củng cố vị thế của Google như một công cụ tìm kiếm hàng đầu.

Google BERT hoạt động như thế nào?

BERT hoạt động bằng cách sử dụng mô hình mã hóa hai chiều và kiến trúc Transformer để xử lý và hiểu ngữ cảnh của từ ngữ trong một chuỗi văn bản. Quá trình này bao gồm hai giai đoạn chính: tiền huấn luyện trên lượng lớn dữ liệu không gắn nhãn và tinh chỉnh cho các tác vụ ngôn ngữ cụ thể.

Khái niệm mô hình hai chiều (Bidirectional)

Mô hình hai chiều là cốt lõi của cách BERT hiểu ngôn ngữ. Thay vì xử lý các từ trong một câu theo một chiều nhất định (ví dụ: chỉ từ trái sang phải như các mô hình ngôn ngữ truyền thống), BERT phân tích mối quan hệ giữa các từ từ cả hai hướng cùng một lúc. Điều này có nghĩa là khi BERT xử lý một từ cụ thể, nó sẽ xem xét tất cả các từ đứng trước và đứng sau từ đó để xác định ngữ cảnh và ý nghĩa chính xác.

Khả năng này mang lại lợi thế đáng kể. Ví dụ, trong câu “chiếc xe khách đang đậu trên ngân hàng”, một mô hình một chiều có thể hiểu “ngân hàng” là một tổ chức tài chính. Tuy nhiên, với mô hình hai chiều, BERT sẽ nhận ra từ “đậu” và “xe khách” ở gần đó, từ đó hiểu rằng “ngân hàng” ở đây có nghĩa là “bờ sông” hoặc “bờ kè”, không phải tổ chức tài chính. Điều này giúp BERT nắm bắt được sắc thái và ý nghĩa thực sự của từ ngữ trong ngữ cảnh cụ thể, cải thiện độ chính xác trong việc hiểu ngôn ngữ tự nhiên.

Quá trình tiền huấn luyện (Pre-training)

Quá trình tiền huấn luyện là giai đoạn đầu tiên và quan trọng trong việc phát triển mô hình BERT. Trong giai đoạn này, BERT được huấn luyện trên một lượng khổng lồ dữ liệu văn bản không gắn nhãn (unlabeled text), chẳng hạn như toàn bộ Wikipedia và Google Books Corpus. Mục tiêu là để mô hình tự học được biểu diễn ngữ nghĩa và ngữ pháp chung của ngôn ngữ.

Quá trình tiền huấn luyện này sử dụng hai tác vụ chính:

* Masked Language Model (MLM): Khoảng 15% số từ trong mỗi câu sẽ bị che đi ngẫu nhiên (masking). Mô hình BERT sau đó được yêu cầu dự đoán các từ bị che dựa trên ngữ cảnh của các từ xung quanh. Tác vụ này buộc mô hình phải hiểu mối quan hệ hai chiều của từ và nắm bắt được ngữ cảnh một cách sâu sắc để điền vào chỗ trống một cách chính xác.

* Next Sentence Prediction (NSP): Mô hình được đưa cho hai câu (A và B) và phải dự đoán xem câu B có phải là câu tiếp theo logic của câu A hay không. Điều này giúp BERT hiểu mối quan hệ giữa các câu, ngữ cảnh dài hơn và cách các ý tưởng liên kết với nhau trong một văn bản.

Thông qua việc thực hiện các tác vụ này trên hàng tỷ từ, BERT xây dựng một sự hiểu biết mạnh mẽ và tổng quát về cấu trúc và ý nghĩa của ngôn ngữ.

Quá trình tinh chỉnh (Fine-tuning)

Sau khi hoàn thành giai đoạn tiền huấn luyện, mô hình BERT đã có một nền tảng vững chắc về ngôn ngữ. Giai đoạn thứ hai là tinh chỉnh (fine-tuning). Trong giai đoạn này, mô hình BERT đã được tiền huấn luyện sẽ được huấn luyện thêm trên một bộ dữ liệu nhỏ hơn, có gắn nhãn, liên quan đến một tác vụ NLP cụ thể (ví dụ: phân loại văn bản, trả lời câu hỏi, nhận dạng thực thể có tên).

Quá trình tinh chỉnh này chỉ yêu cầu một lượng dữ liệu tương đối nhỏ và thời gian huấn luyện ngắn hơn nhiều so với giai đoạn tiền huấn luyện. Mô hình BERT có thể thích nghi và đạt hiệu suất cao cho nhiều ứng dụng khác nhau mà không cần phải huấn luyện lại từ đầu. Ví dụ, nếu Google muốn BERT trả lời câu hỏi, họ sẽ tinh chỉnh nó trên một bộ dữ liệu các cặp câu hỏi-trả lời. Điều này cho phép BERT có khả năng thích ứng linh hoạt và hiệu quả với nhiều yêu cầu tìm kiếm và xử lý ngôn ngữ khác nhau.

Kiến trúc Transformer (Nền tảng công nghệ)

Nền tảng công nghệ cho BERT là kiến trúc Transformer, một mô hình mạng nơ-ron được Google giới thiệu vào năm 2017. Transformer đã cách mạng hóa lĩnh vực xử lý ngôn ngữ tự nhiên nhờ vào việc sử dụng cơ chế “attention” (cơ chế chú ý).

Cơ chế attention cho phép mô hình gán trọng số khác nhau cho các từ khác nhau trong một câu khi xử lý một từ cụ thể. Điều này có nghĩa là khi BERT xử lý một từ, nó không chỉ nhìn vào các từ gần nhất mà còn có thể tập trung vào những từ quan trọng nhất, dù chúng ở xa trong câu. Ví dụ, trong câu “Con sông này đẹp như một dải lụa, và bờ của nó là nơi lý tưởng để đi dạo”, khi BERT xử lý từ “bờ”, nó sẽ “chú ý” nhiều hơn đến từ “sông” để hiểu rằng “bờ” ở đây là bờ sông, không phải bờ biển hay bờ tường.

Kiến trúc Transformer với cơ chế attention giúp BERT xử lý các chuỗi dài hiệu quả hơn, nắm bắt được các mối quan hệ phụ thuộc xa giữa các từ mà các mô hình tuần tự trước đây thường bỏ lỡ. Đây là yếu tố then chốt giúp BERT có khả năng hiểu ngữ cảnh mạnh mẽ và chính xác, vượt trội so với các thuật toán NLP trước đó.

Thuật toán BERT ảnh hưởng đến SEO và kết quả tìm kiếm Google ra sao?

Thuật toán BERT ảnh hưởng đáng kể đến SEO và kết quả tìm kiếm Google bằng cách thay đổi cách công cụ tìm kiếm hiểu ý định tìm kiếm của người dùng. Điều này dẫn đến việc Google ưu tiên các nội dung cung cấp ngữ cảnh đầy đủ, chính xác và có liên quan mật thiết đến truy vấn, đặc biệt là các truy vấn dạng câu hỏi hoặc có cấu trúc phức tạp.

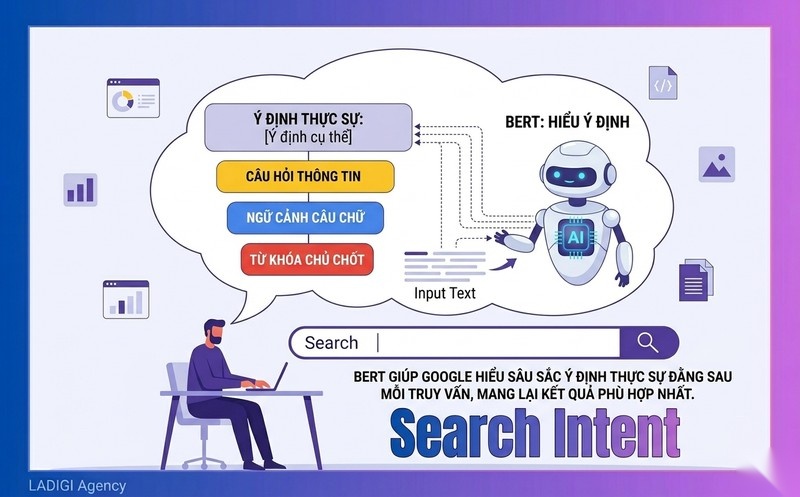

Hiểu sâu sắc ý định tìm kiếm (Search Intent)

Tác động lớn nhất của BERT đối với SEO là khả năng giúp Google hiểu sâu sắc hơn về ý định tìm kiếm (Search Intent) của người dùng. Trước BERT, Google thường chỉ tập trung vào các từ khóa riêng lẻ. Tuy nhiên, với BERT, Google có thể phân tích toàn bộ truy vấn, bao gồm cả các từ nối, giới từ và thứ tự từ, để nắm bắt ý nghĩa ngữ cảnh và ý định thực sự đằng sau câu hỏi.

Ví dụ, truy vấn “cách nấu món phở chay đơn giản không dùng nấm” sẽ được BERT hiểu đúng là tìm kiếm công thức phở chay không chứa nấm, thay vì bỏ qua từ “không” và hiển thị các công thức có nấm. Điều này có nghĩa là nội dung của bạn cần phải trả lời trực tiếp và toàn diện ý định này. Các trang web cung cấp thông tin phù hợp với ngữ cảnh truy vấn sẽ được ưu tiên hiển thị, trong khi nội dung chỉ nhồi nhét từ khóa nhưng không giải quyết đúng ý định sẽ kém hiệu quả hơn.

Đánh giá chất lượng và mức độ liên quan nội dung

BERT giúp Google đánh giá chất lượng và mức độ liên quan của nội dung một cách tinh vi hơn. Thay vì chỉ khớp từ khóa đơn thuần, thuật toán này cho phép Google xác định xem một trang web có thực sự cung cấp giá trị và giải quyết triệt để chủ đề theo đúng ngữ cảnh của truy vấn hay không. Nội dung không chỉ cần chứa các từ khóa mục tiêu mà còn phải thể hiện sự hiểu biết sâu sắc, toàn diện về chủ đề đó.

Những trang web có nội dung chung chung, thiếu chiều sâu, hoặc nhồi nhét từ khóa mà không mang lại giá trị thông tin thực sự sẽ bị BERT đánh giá thấp hơn. Ngược lại, các trang có nội dung được viết tự nhiên, mạch lạc, cung cấp thông tin chi tiết và chính xác, phù hợp với ngữ cảnh tìm kiếm của người dùng sẽ được xếp hạng cao hơn. Điều này khuyến khích các nhà sáng tạo nội dung tập trung vào chất lượng, tính chuyên sâu và sự hữu ích cho độc giả.

Tối ưu hóa các đoạn trích nổi bật (Featured Snippets)

Featured Snippets là các đoạn thông tin ngắn gọn, trực tiếp mà Google hiển thị ở đầu kết quả tìm kiếm (vị trí “zero”) nhằm trả lời nhanh chóng các câu hỏi của người dùng. Khả năng hiểu ngữ cảnh vượt trội của BERT đã góp phần lớn vào việc tối ưu hóa cách Google xác định và hiển thị các đoạn trích nổi bật này.

BERT giúp Google xác định chính xác hơn các đoạn văn bản trong một trang web có thể trả lời trực tiếp một câu hỏi cụ thể, ngay cả khi câu hỏi đó phức tạp hoặc chứa các sắc thái ngôn ngữ. Đối với các SEOer, điều này mở ra cơ hội lớn để chiếm lĩnh Featured Snippets bằng cách cấu trúc nội dung một cách rõ ràng, trả lời các câu hỏi tiềm năng của người dùng một cách trực tiếp, súc tích ngay từ đầu. Nội dung được trình bày dưới dạng danh sách, bảng biểu hoặc đoạn văn ngắn gọn, dễ hiểu có nhiều khả năng được chọn làm Featured Snippet hơn.

Mối quan hệ với RankBrain

BERT và RankBrain đều là các thành phần dựa trên trí tuệ nhân tạo của thuật toán tìm kiếm của Google, nhưng chúng có vai trò khác nhau và bổ trợ cho nhau.

* RankBrain: Là một hệ thống AI dựa trên máy học, được giới thiệu vào năm 2015. RankBrain tập trung vào việc hiểu các truy vấn chưa từng thấy trước đây và ánh xạ chúng với các từ khóa đã biết để tìm ra kết quả phù hợp nhất. Nó giúp Google hiểu ý định tổng thể của truy vấn (ví dụ: “người dùng muốn gì khi tìm kiếm cụm từ này?”). RankBrain xử lý “tìm kiếm mới” và dịch các truy vấn mơ hồ thành các khái niệm mà Google có thể hiểu.

* BERT: Ra mắt sau RankBrain, tập trung vào việc hiểu ngữ cảnh và ý nghĩa của từng từ trong một truy vấn hoặc tài liệu, đặc biệt là với các từ nối và giới từ quan trọng. BERT giúp Google hiểu “ngôn ngữ” tốt hơn (ví dụ: “từ này có nghĩa gì trong ngữ cảnh cụ thể của câu này?”).

Nói cách khác, RankBrain giúp Google hiểu ý định tổng thể của một truy vấn (ví dụ, liệu “Apple” là trái cây hay công ty). Còn BERT giúp Google hiểu các sắc thái ngôn ngữ trong truy vấn đó để đưa ra kết quả chính xác hơn (ví dụ, “Làm thế nào để gọt vỏ một quả apple?” so với “Giá cổ phiếu của Apple hôm nay là bao nhiêu?”). Cả hai đều hoạt động cùng nhau để cải thiện độ chính xác và mức độ liên quan của kết quả tìm kiếm, nhưng mỗi thuật toán giải quyết một khía cạnh khác nhau của sự hiểu biết ngôn ngữ.

Tối ưu nội dung cho Google BERT như thế nào?

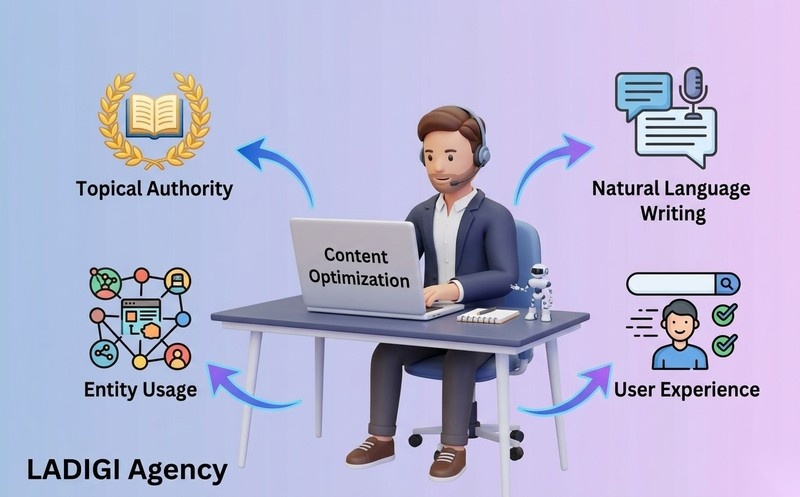

Tối ưu nội dung cho Google BERT đòi hỏi một sự chuyển dịch trọng tâm từ việc nhồi nhét từ khóa sang việc tạo ra nội dung chất lượng cao, tự nhiên, toàn diện và đáp ứng sâu sắc ý định tìm kiếm của người dùng. Các bước thực hành sau đây sẽ giúp bạn xây dựng chiến lược nội dung hiệu quả trong kỷ nguyên BERT.

Tập trung vào chủ đề toàn diện (Topical Authority)

Để tối ưu cho BERT, hãy dịch chuyển trọng tâm từ việc chỉ tối ưu cho các từ khóa riêng lẻ sang việc xây dựng “Topical Authority” – thẩm quyền về chủ đề. Điều này có nghĩa là bạn cần cung cấp thông tin đầy đủ, sâu sắc và bao quát tất cả các khía cạnh liên quan đến một chủ đề cụ thể, không chỉ gói gọn trong một vài từ khóa.

- Cách làm:

- Tạo content clusters: Xây dựng một “pillar page” (trang trụ cột) bao quát chủ đề chính, sau đó liên kết đến các “cluster content” (nội dung cụm) chi tiết hơn cho từng khía cạnh nhỏ của chủ đề.

- Bao phủ đa dạng các câu hỏi: Nghiên cứu và trả lời mọi câu hỏi, thắc mắc mà người dùng có thể có về chủ đề đó.

- Cung cấp góc nhìn chuyên sâu: Đừng chỉ dừng lại ở bề mặt, hãy đào sâu vào các vấn đề, đưa ra giải pháp và kiến thức chuyên môn.

Việc này cho Google thấy rằng trang web của bạn là một nguồn đáng tin cậy, có thẩm quyền và cung cấp giá trị thực sự về chủ đề đó, từ đó nâng cao cơ hội xếp hạng cho nhiều truy vấn liên quan.

Viết nội dung tự nhiên, rõ ràng và mạch lạc

BERT được thiết kế để hiểu ngôn ngữ tự nhiên. Do đó, việc viết nội dung một cách tự nhiên, rõ ràng và mạch lạc là yếu tố then chốt.

- Ưu tiên ngôn ngữ tự nhiên: Tránh nhồi nhét từ khóa một cách gượng ép. Thay vào đó, hãy viết như cách bạn nói chuyện hoặc giải thích cho một người khác. Sử dụng các từ đồng nghĩa và cụm từ liên quan một cách tự nhiên.

- Cấu trúc câu và đoạn văn rõ ràng: Sử dụng các câu ngắn, dễ hiểu. Chia đoạn văn thành các phần nhỏ, không quá dài (tối đa 4-5 dòng). Điều này giúp người đọc dễ dàng quét thông tin và cũng giúp BERT xử lý nội dung tốt hơn.

- Luồng thông tin logic: Đảm bảo nội dung có một luồng thông tin hợp lý, từ khái niệm cơ bản đến chi tiết, từ vấn đề đến giải pháp. Các ý nên được trình bày theo trình tự có tính kết nối.

- Sử dụng tiêu đề và phụ đề: Sử dụng các thẻ H2, H3, H4 một cách hợp lý để cấu trúc nội dung, giúp người đọc (và BERT) dễ dàng nắm bắt các ý chính và mối quan hệ giữa chúng.

Mục tiêu là tạo ra nội dung mà con người có thể dễ dàng hiểu và tiêu thụ, đồng thời giúp BERT dễ dàng phân tích và xác định ý nghĩa ngữ cảnh.

Sử dụng thực thể (Entity) và ngữ cảnh chính xác

Các thực thể (Entities) là các khái niệm, đối tượng, địa điểm, con người hoặc sự vật có tên riêng và ý nghĩa cụ thể (ví dụ: “Thành phố Hồ Chí Minh”, “iPhone 15”, “ChatGPT”, “Elon Musk”). Google sử dụng các thực thể để hiểu sâu hơn về nội dung và mối quan hệ giữa các khái niệm.

- Xác định và sử dụng thực thể liên quan: Đảm bảo rằng bạn đã xác định các thực thể chính trong chủ đề của mình và sử dụng chúng một cách chính xác trong ngữ cảnh.

- Định nghĩa rõ ràng (nếu cần): Nếu bạn đang giới thiệu một thực thể mới hoặc phức tạp, hãy cung cấp một định nghĩa ngắn gọn, rõ ràng.

- Kết nối thực thể: Sử dụng các liên kết nội bộ để kết nối các thực thể có liên quan trên trang web của bạn, giúp Google xây dựng một biểu đồ kiến thức (Knowledge Graph) mạnh mẽ hơn về chủ đề của bạn.

- Đảm bảo ngữ cảnh chính xác: Ví dụ, nếu bạn nói về “Apple”, hãy đảm bảo ngữ cảnh trong bài viết cho phép BERT phân biệt rõ ràng đó là công ty công nghệ hay loại trái cây.

Việc sử dụng thực thể một cách có ý thức và chính xác giúp BERT hiểu được sự tinh tế của nội dung và xếp hạng nó một cách phù hợp hơn cho các truy vấn liên quan.

Giải đáp trọn vẹn ý định và nhu cầu người dùng

Với BERT, việc giải đáp trọn vẹn ý định tìm kiếm và nhu cầu của người dùng trở nên quan trọng hơn bao giờ hết. Điều này đòi hỏi bạn phải thực hiện nghiên cứu từ khóa không chỉ để biết “người dùng tìm gì” mà còn để hiểu “tại sao họ tìm điều đó” và “họ muốn đạt được điều gì”.

- Phân tích ý định: Trước khi viết, hãy dành thời gian phân tích ý định đằng sau các từ khóa mục tiêu. Người dùng đang tìm kiếm thông tin (Informational), muốn mua hàng (Transactional), điều hướng (Navigational) hay muốn nghiên cứu (Commercial Investigation)?

- Cung cấp câu trả lời toàn diện: Đảm bảo nội dung của bạn trả lời đầy đủ, trực tiếp và thỏa mãn các câu hỏi, thắc mắc, hoặc vấn đề mà người dùng có thể đang gặp phải.

- Dự đoán câu hỏi tiếp theo: Cố gắng dự đoán những câu hỏi tiếp theo mà người dùng có thể có sau khi nhận được câu trả lời ban đầu và giải quyết chúng trong bài viết của bạn.

- Cấu trúc Q&A: Sử dụng định dạng câu hỏi và trả lời (FAQ) hoặc các tiêu đề dạng câu hỏi để làm nổi bật các câu trả lời trực tiếp. Điều này cũng giúp tăng cơ hội xuất hiện trong Featured Snippets.

Nội dung đáp ứng trọn vẹn nhu cầu người dùng sẽ giảm tỷ lệ thoát trang, tăng thời gian ở lại và tỷ lệ tương tác, tất cả đều là các tín hiệu tích cực cho Google.

Cải thiện trải nghiệm người dùng (UX) trên trang

Mặc dù BERT trực tiếp liên quan đến việc hiểu ngôn ngữ, trải nghiệm người dùng (UX) vẫn gián tiếp đóng vai trò quan trọng trong việc tối ưu hóa cho thuật toán này. Một UX tốt giúp người dùng dễ dàng tương tác và tiêu thụ nội dung, từ đó gián tiếp báo hiệu cho Google về chất lượng của trang.

- Tốc độ tải trang nhanh: Đảm bảo trang web của bạn tải nhanh chóng trên cả máy tính và thiết bị di động. Tốc độ tải trang kém có thể khiến người dùng rời đi trước khi BERT có cơ hội “đọc” nội dung của bạn.

- Thiết kế thân thiện với di động (Mobile-friendliness): Google ưu tiên các trang web thân thiện với di động. Đảm bảo nội dung của bạn hiển thị và hoạt động hoàn hảo trên mọi kích thước màn hình.

- Cấu trúc dễ đọc và dễ quét:

- Sử dụng đoạn văn ngắn, bullet points, danh sách đánh số để dễ đọc.

- Sử dụng hình ảnh, video chất lượng cao để minh họa và làm phong phú nội dung.

- Tránh các khối văn bản lớn, dày đặc.

- Điều hướng dễ dàng: Cung cấp menu rõ ràng, thanh tìm kiếm hiệu quả và các liên kết nội bộ hợp lý để giúp người dùng dễ dàng tìm thấy thông tin liên quan khác trên trang web của bạn.

Một trải nghiệm người dùng tích cực khuyến khích người dùng tương tác lâu hơn với nội dung, giúp BERT (và các thuật toán khác của Google) nhận ra giá trị của trang.

Những câu hỏi thường gặp về Google BERT (FAQ)

Phần này sẽ giải đáp các thắc mắc phổ biến về Google BERT, giúp bạn có cái nhìn toàn diện và chính xác hơn về thuật toán này và cách nó tác động đến SEO.

BERT có phải là yếu tố xếp hạng trực tiếp không?

Không, BERT không phải là một yếu tố xếp hạng trực tiếp theo cách truyền thống. BERT là một phần của hệ thống hiểu ngôn ngữ tổng thể của Google. Thay vì tự mình xếp hạng trang web, BERT giúp Google hiểu truy vấn và nội dung tốt hơn.

Bằng cách hiểu sâu sắc ngữ cảnh của truy vấn và nội dung trên trang, BERT giúp Google đánh giá mức độ liên quan của một trang web đối với một tìm kiếm cụ thể. Do đó, nó gián tiếp ảnh hưởng đến khả năng xếp hạng của một trang bằng cách giúp Google đưa ra quyết định chính xác hơn về việc nội dung đó có thực sự phù hợp với ý định tìm kiếm của người dùng hay không. Các trang cung cấp thông tin liên quan và chất lượng cao sẽ có cơ hội được hiển thị và xếp hạng tốt hơn nhờ BERT.

Google BERT khác gì so với RankBrain?

Google BERT và RankBrain là hai công nghệ AI riêng biệt nhưng bổ trợ cho nhau trong hệ thống tìm kiếm của Google.

- RankBrain: Là một hệ thống AI dựa trên máy học, được giới thiệu vào năm 2015. RankBrain chủ yếu tập trung vào việc hiểu các truy vấn chưa từng thấy trước đây hoặc mơ hồ bằng cách ánh xạ chúng với các từ khóa và chủ đề đã biết. Nó giúp Google hiểu ý định tổng thể của truy vấn tìm kiếm, đặc biệt khi gặp các từ khóa lạ hoặc các câu hỏi phức tạp. RankBrain tập trung vào việc “dịch” truy vấn của người dùng thành các khái niệm mà Google có thể xử lý.

- BERT: Ra mắt vào năm 2019, BERT tập trung vào việc hiểu ngữ cảnh và ý nghĩa của từng từ trong một truy vấn hoặc tài liệu. Nó đặc biệt hiệu quả với các từ nối và giới từ, giúp Google nắm bắt các sắc thái ngôn ngữ để hiểu ý nghĩa chính xác của câu hỏi. BERT không chỉ hiểu ý định chung mà còn hiểu từng từ trong ngữ cảnh.

Tóm lại, RankBrain giúp Google hiểu ý định tổng thể của một truy vấn (người dùng muốn gì?), trong khi BERT giúp Google hiểu ý nghĩa ngữ cảnh chính xác của từng từ trong truy vấn và tài liệu (từ này có nghĩa gì trong câu này?). Cả hai cùng hoạt động để cải thiện độ chính xác và mức độ liên quan của kết quả tìm kiếm.

Thuật toán BERT có ảnh hưởng đến tất cả các tìm kiếm không?

Khi ra mắt vào tháng 10 năm 2019, BERT ban đầu ảnh hưởng đến khoảng 10% các truy vấn tìm kiếm bằng tiếng Anh. Tuy nhiên, Google đã liên tục mở rộng phạm vi áp dụng của BERT.

Hiện tại, thuật toán BERT đã được triển khai cho hầu hết các truy vấn và hỗ trợ nhiều ngôn ngữ khác nhau trên toàn cầu, bao gồm cả tiếng Việt. BERT có tác động lớn nhất đến các truy vấn dài, phức tạp, hoặc các câu hỏi đòi hỏi sự hiểu biết sâu sắc về ngữ cảnh, nơi mà các từ nối và giới từ đóng vai trò quan trọng trong việc xác định ý nghĩa. Đối với các truy vấn đơn giản, ngắn gọn, tác động của BERT có thể ít rõ rệt hơn.

Có cần tối ưu từ khóa cụ thể cho BERT không?

Không, không có khái niệm “tối ưu từ khóa cụ thể cho BERT”. Cách tiếp cận tốt nhất để “tối ưu” cho BERT là ngừng tập trung vào việc nhồi nhét từ khóa hoặc cố gắng “lừa” thuật toán.

Thay vào đó, bạn nên tập trung vào việc tạo ra nội dung chất lượng cao, tự nhiên, cung cấp giá trị thực sự cho người dùng. Điều này bao gồm:

* Viết nội dung rõ ràng, mạch lạc, dễ hiểu.

* Trả lời đầy đủ các câu hỏi và nhu cầu của người dùng.

* Sử dụng ngôn ngữ tự nhiên, như cách người thật giao tiếp.

* Tập trung vào ngữ cảnh và ý nghĩa tổng thể của chủ đề.

Nếu nội dung của bạn được viết tốt, có tính hữu ích cao và cung cấp thông tin toàn diện mà con người có thể dễ dàng hiểu, thì BERT cũng sẽ hiểu nó tốt hơn và tăng cơ hội nội dung của bạn được xếp hạng cao cho các truy vấn liên quan.

Các bản cập nhật sau BERT của Google là gì?

BERT là một phần trong hành trình phát triển không ngừng của Google về khả năng xử lý ngôn ngữ tự nhiên (NLP) và trí tuệ nhân tạo. Sau BERT, Google đã giới thiệu hoặc tiếp tục phát triển các mô hình và thuật toán tiên tiến hơn:

- MUM (Multitask Unified Model): Được công bố vào năm 2021, MUM là một mô hình tiên tiến hơn BERT, có khả năng hiểu đa nhiệm và đa ngôn ngữ. Không giống như BERT chủ yếu hiểu ngữ cảnh, MUM có thể tổng hợp thông tin từ nhiều nguồn và định dạng (văn bản, hình ảnh, video) để trả lời các câu hỏi phức tạp đòi hỏi nhiều bước. MUM không chỉ hiểu mà còn có thể tạo ra thông tin.

- LaMDA (Language Model for Dialogue Applications): Mặc dù tập trung nhiều hơn vào các ứng dụng hội thoại, LaMDA là một mô hình ngôn ngữ lớn khác của Google, được thiết kế để tạo ra các cuộc đối thoại tự nhiên và trôi chảy, phản ánh sự hiểu biết sâu sắc về ngữ cảnh.

Các bản cập nhật này cho thấy Google tiếp tục đầu tư mạnh mẽ vào các mô hình AI để hiểu ngôn ngữ tự nhiên sâu sắc hơn, hướng tới việc trả lời các truy vấn ngày càng phức tạp, cung cấp trải nghiệm tìm kiếm giống như trò chuyện với một chuyên gia.

BERT có hỗ trợ đa ngôn ngữ không?

Có, BERT có hỗ trợ đa ngôn ngữ. Mặc dù phiên bản đầu tiên của BERT được giới thiệu và tập trung vào tiếng Anh, Google đã nhanh chóng mở rộng khả năng của nó để bao gồm nhiều ngôn ngữ khác trên thế giới.

Có các phiên bản BERT được gọi là “Multilingual BERT” được huấn luyện trên dữ liệu từ hàng trăm ngôn ngữ khác nhau. Điều này cho phép BERT hoạt động hiệu quả trong việc hiểu và xử lý các truy vấn và nội dung bằng nhiều ngôn ngữ, bao gồm tiếng Việt. Khả năng đa ngôn ngữ của BERT là rất quan trọng, vì nó giúp Google cung cấp kết quả tìm kiếm chất lượng cao cho người dùng ở khắp mọi nơi, bất kể ngôn ngữ họ sử dụng.

Google BERT đã định hình lại cách công cụ tìm kiếm hiểu ngôn ngữ, từ đó thay đổi cuộc chơi SEO bằng cách ưu tiên nội dung có ngữ cảnh, tự nhiên và đáp ứng sâu sắc ý định người dùng. Việc tập trung vào chất lượng, sự mạch lạc và trải nghiệm người dùng là chìa khóa để nội dung của bạn được BERT và Google đánh giá cao.

Để xây dựng chiến lược nội dung và SEO tối ưu cho các thuật toán AI mới nhất của Google, bao gồm BERT và MUM, hãy liên hệ ngay với LADIGI Agency để được tư vấn chuyên sâu.