- Large Language Models (LLM) là các mô hình AI sử dụng mạng lưới thần kinh sâu (deep neural networks) với hàng tỷ tham số, được huấn luyện trên lượng lớn dữ liệu văn bản để hiểu, tạo và xử lý ngôn ngữ tự nhiên.

- Kiến trúc Transformer là nền tảng cốt lõi của hầu hết LLM hiện đại, cho phép xử lý song song và hiểu ngữ cảnh vượt trội thông qua cơ chế self-attention.

- Huấn luyện LLM gồm hai giai đoạn chính: pre-training trên dữ liệu khổng lồ để học ngữ pháp, ngữ nghĩa, và fine-tuning để thích nghi với các nhiệm vụ cụ thể.

- Ứng dụng đột phá của LLM bao gồm tối ưu hóa SEO, phát triển chatbot, dịch thuật tự động, phân tích dữ liệu, cá nhân hóa giáo dục, tạo mã và hỗ trợ nghiên cứu khoa học.

- Thách thức lớn của LLM là hiện tượng “ảo giác” (hallucination) tạo thông tin sai lệch, vấn đề đạo đức, chi phí vận hành cao và tính thiếu minh bạch (“black box”).

- Tương lai của LLM hướng tới khả năng đa phương thức, hiệu suất cao hơn với chi phí thấp hơn, và tích hợp sâu hơn vào các hệ thống tìm kiếm như AI Overview.

- LLM không thay thế hoàn toàn con người trong SEO mà là công cụ hỗ trợ mạnh mẽ, đòi hỏi chiến lược và sự giám sát của chuyên gia để đảm bảo chất lượng và E-E-A-T.

Từ những điểm chính trên, LADIGI Agency nhận thấy Large Language Models đang định hình lại nhiều khía cạnh của công nghệ và kinh doanh, đặc biệt là trong lĩnh vực xử lý thông tin và tối ưu hóa tìm kiếm. Để hiểu rõ hơn về cách thức hoạt động, các ứng dụng tiềm năng cũng như những thách thức cần vượt qua, chúng ta sẽ đi sâu vào từng khía cạnh của LLM.

Large Language Models (LLM) là gì?

Large Language Models (LLM) là một loại mô hình trí tuệ nhân tạo (AI) được thiết kế để hiểu, tạo và thao tác với ngôn ngữ tự nhiên của con người. Các mô hình này được xây dựng dựa trên kiến trúc mạng thần kinh sâu, đặc biệt là kiến trúc Transformer, và được huấn luyện trên một lượng dữ liệu văn bản khổng lồ, thường bao gồm hàng tỷ từ và cụm từ từ internet, sách, và các nguồn văn bản khác.

Khái niệm

Large Language Models nổi bật bởi khả năng:

- Hiểu ngữ cảnh: Phân tích và nắm bắt ý nghĩa của văn bản trong nhiều ngữ cảnh khác nhau.

- Sinh văn bản tự nhiên: Tạo ra văn bản mạch lạc, ngữ pháp đúng và phù hợp với phong cách được yêu cầu.

- Tổng quát hóa: Áp dụng kiến thức đã học từ dữ liệu huấn luyện để giải quyết các nhiệm vụ mới mà không cần huấn luyện lại từ đầu.

- Quy mô lớn: Thường có hàng tỷ hoặc thậm chí hàng nghìn tỷ tham số (parameters), cho phép chúng học được các mẫu phức tạp trong ngôn ngữ.

Các ví dụ điển hình về Large Language Models bao gồm GPT-3, GPT-4 của OpenAI, PaLM và Gemini của Google, LLaMA của Meta, và Claude của Anthropic.

Lịch sử phát triển

Sự phát triển của Large Language Models là đỉnh cao của nhiều thập kỷ nghiên cứu trong lĩnh vực Xử lý Ngôn ngữ Tự nhiên (NLP):

- Những năm 1950 – 1980: NLP dựa trên quy tắc: Giai đoạn đầu, NLP chủ yếu dựa vào các quy tắc ngữ pháp và từ điển được con người lập trình thủ công. Phương pháp này hạn chế về khả năng mở rộng và xử lý ngôn ngữ tự nhiên phong phú.

- Những năm 1990 – 2000: NLP thống kê: Chuyển sang các mô hình thống kê như Hidden Markov Models (HMMs) và Conditional Random Fields (CRFs). Các mô hình này học các mẫu từ dữ liệu, cải thiện đáng kể độ chính xác.

- Những năm 2010 – giữa 2010: Mạng thần kinh truyền thống: Sự xuất hiện của các kiến trúc mạng thần kinh như Recurrent Neural Networks (RNNs) và Long Short-Term Memory (LSTMs) đã cho phép các mô hình xử lý chuỗi dữ liệu (như ngôn ngữ) tốt hơn, nắm bắt được phụ thuộc dài hạn trong câu.

- 2017: Kiến trúc Transformer ra đời: Bài báo “Attention Is All You Need” của Google đã giới thiệu kiến trúc Transformer. Đây là một bước đột phá lớn vì:

- Cơ chế Self-Attention: Cho phép mô hình đánh giá tầm quan trọng của các từ khác trong câu khi xử lý từng từ, giúp nắm bắt ngữ cảnh hiệu quả hơn nhiều so với RNN/LSTM.

- Xử lý song song: Transformer có thể xử lý các phần khác nhau của đầu vào cùng lúc, giảm đáng kể thời gian huấn luyện trên các tập dữ liệu lớn.

- Cuối 2018: Sự bùng nổ của Large Language Models:

- BERT (Bidirectional Encoder Representations from Transformers) của Google: Mô hình đầu tiên áp dụng Transformer cho pre-training hai chiều, mở ra kỷ nguyên mới cho các nhiệm vụ hiểu ngôn ngữ.

- GPT (Generative Pre-trained Transformer) của OpenAI: Các phiên bản GPT (GPT-1, GPT-2, GPT-3) đã chứng minh khả năng sinh văn bản tự nhiên, mạch lạc, và có tính sáng tạo, định hình xu hướng phát triển các mô hình ngôn ngữ lớn dựa trên kiến trúc decoder-only của Transformer.

- Hiện tại: LLM tiếp tục phát triển với kích thước lớn hơn, hiệu suất cao hơn, và khả năng đa phương thức (multimodality), tích hợp xử lý văn bản, hình ảnh, âm thanh.

Nguyên lý hoạt động của Large Language Models

Nguyên lý hoạt động của Large Language Models tập trung vào việc xử lý một lượng lớn dữ liệu ngôn ngữ để học các mẫu ngữ pháp, ngữ nghĩa, và ngữ cảnh, sau đó sử dụng kiến thức này để dự đoán hoặc tạo ra văn bản mới.

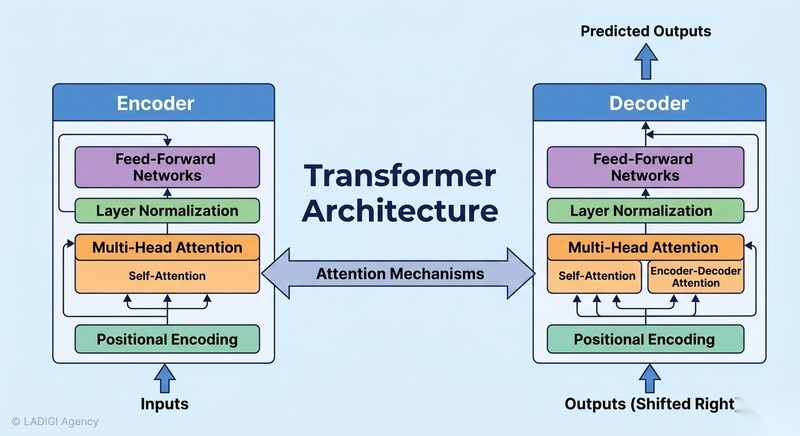

Kiến trúc mạng Transformer

Kiến trúc Transformer là xương sống của hầu hết các Large Language Models hiện đại. Nó giải quyết các hạn chế của mạng thần kinh truyền thống (RNN, LSTM) trong việc xử lý phụ thuộc dài hạn và song song hóa.

- Thành phần chính:

- Encoder: Xử lý đầu vào, tạo ra biểu diễn ngữ cảnh cho mỗi từ. Encoder thường được sử dụng trong các tác vụ hiểu ngôn ngữ (ví dụ: phân loại, tóm tắt).

- Decoder: Tạo ra đầu ra, sử dụng biểu diễn từ encoder và các từ đã tạo trước đó để dự đoán từ tiếp theo. Decoder thường được sử dụng trong các tác vụ sinh ngôn ngữ (ví dụ: dịch thuật, tạo văn bản).

- Nhiều Large Language Models hiện đại như GPT chỉ sử dụng phần Decoder của kiến trúc Transformer.

- Cơ chế Self-Attention (Tự Chú ý):

- Là cốt lõi của Transformer, cho phép mô hình cân nhắc mức độ liên quan của các từ khác trong câu khi xử lý một từ cụ thể.

- Mỗi từ trong câu được gán ba vectơ: Query (Q), Key (K), và Value (V).

- Query của một từ được so sánh với Key của tất cả các từ khác để tính toán “điểm chú ý” (attention scores).

- Các điểm này sau đó được sử dụng để tạo ra một tổng trọng số của các vectơ Value, tạo thành biểu diễn ngữ cảnh mới cho từ đó.

- Cơ chế này giúp mô hình nắm bắt được phụ thuộc từ xa trong câu mà không bị hạn chế bởi khoảng cách tuần tự.

- Multi-Head Attention:

- Thay vì một cơ chế attention duy nhất, Multi-Head Attention sử dụng nhiều “đầu” attention song song.

- Mỗi “đầu” học một loại mối quan hệ khác nhau giữa các từ, cho phép mô hình nắm bắt nhiều khía cạnh ngữ nghĩa và cú pháp cùng lúc.

- Positional Encoding (Mã hóa vị trí):

- Transformer không có cơ chế tự nhiên để hiểu thứ tự của các từ trong câu như RNN/LSTM.

- Positional Encoding được thêm vào các embeddings của từ để cung cấp thông tin về vị trí tương đối của mỗi từ trong chuỗi đầu vào.

- Feed-Forward Networks:

- Sau mỗi lớp attention, dữ liệu đi qua một mạng thần kinh thuần túy (feed-forward network) để xử lý thêm.

- Các mạng này áp dụng các phép biến đổi phi tuyến tính để tinh chỉnh các biểu diễn.

- Layer Normalization và Residual Connections:

- Được sử dụng để ổn định quá trình huấn luyện các mạng sâu.

- Residual Connections giúp gradient truyền đi dễ dàng hơn qua các lớp.

Dữ liệu và phương pháp huấn luyện

Quá trình huấn luyện Large Language Models thường bao gồm hai giai đoạn chính:

- Giai đoạn Pre-training (Huấn luyện trước):

- Dữ liệu: Large Language Models được huấn luyện trên một lượng dữ liệu văn bản khổng lồ, đa dạng, bao gồm sách, bài viết trên web (Common Crawl), Wikipedia, báo chí, v.v. Kích thước dữ liệu thường lên đến hàng terabyte.

- Mục tiêu: Học cách dự đoán từ tiếp theo trong một câu (predictive language modeling) hoặc điền vào các từ bị thiếu trong một đoạn văn (masked language modeling).

- Phương pháp: Đây là quá trình tự giám sát (self-supervised learning). Mô hình tự tạo ra các nhãn từ dữ liệu đầu vào. Ví dụ, trong dự đoán từ tiếp theo, từ hiện tại là đầu vào và từ sau nó là nhãn.

- Kết quả: Sau pre-training, mô hình có được một sự hiểu biết sâu sắc về ngữ pháp, ngữ nghĩa, cấu trúc câu, kiến thức thế giới, và các mẫu ngôn ngữ phổ biến. Mô hình có khả năng tổng quát hóa cao và có thể thực hiện nhiều nhiệm vụ ngôn ngữ cơ bản.

- Giai đoạn Fine-tuning (Điều chỉnh tinh):

- Dữ liệu: Dữ liệu fine-tuning nhỏ hơn nhiều so với pre-training, và được gắn nhãn cho các nhiệm vụ cụ thể (ví dụ: phân loại văn bản, tóm tắt, trả lời câu hỏi).

- Mục tiêu: Điều chỉnh mô hình đã được pre-training để nó thực hiện xuất sắc một nhiệm vụ cụ thể.

- Phương pháp: Sử dụng học có giám sát (supervised learning) với các bộ dữ liệu nhãn cụ thể. Các trọng số của mô hình pre-trained được điều chỉnh nhẹ nhàng để tối ưu hóa hiệu suất cho nhiệm vụ mới.

- Reinforcement Learning from Human Feedback (RLHF): Một phương pháp fine-tuning nâng cao, được sử dụng rộng rãi trong các LLM hiện đại như ChatGPT.

- Mục tiêu là “căn chỉnh” (align) mô hình với ý định của con người, làm cho phản hồi của mô hình hữu ích, trung thực và vô hại.

- Con người đánh giá các phản hồi của mô hình, và các đánh giá này được sử dụng để huấn luyện một mô hình phần thưởng.

- Mô hình phần thưởng sau đó được dùng để tinh chỉnh Large Language Models thông qua học tăng cường (reinforcement learning).

Cơ chế dự đoán và sinh văn bản

Khi một Large Language Models được sử dụng để dự đoán hoặc sinh văn bản, quá trình diễn ra như sau:

- Mã hóa đầu vào (Tokenization):

- Văn bản đầu vào được chia thành các “token” (có thể là từ, một phần của từ, hoặc ký tự).

- Mỗi token được chuyển đổi thành một vector số (embedding).

- Positional Encoding được thêm vào các embeddings này để giữ thông tin về vị trí.

- Xử lý qua các lớp Transformer:

- Các vector token đã được mã hóa vị trí đi qua nhiều lớp Transformer (encoder hoặc decoder tùy kiến trúc).

- Mỗi lớp thực hiện các phép tính self-attention và feed-forward, liên tục tinh chỉnh biểu diễn ngữ cảnh của từng token.

- Dự đoán token tiếp theo:

- Ở lớp đầu ra của decoder, một phân phối xác suất được tạo ra cho tất cả các token có thể có trong từ vựng của mô hình.

- Phân phối này cho biết khả năng xuất hiện của mỗi token tại vị trí tiếp theo.

- Lấy mẫu (Sampling) và sinh văn bản:

- Mô hình chọn token có xác suất cao nhất (greedy decoding) hoặc sử dụng các kỹ thuật lấy mẫu phức tạp hơn (như beam search, top-k sampling, nucleus sampling) để tạo ra sự đa dạng và tự nhiên hơn trong văn bản.

- Token được chọn sau đó được thêm vào chuỗi đầu vào, và quá trình lặp lại để tạo ra token tiếp theo, cho đến khi đạt được độ dài mong muốn hoặc gặp token kết thúc chuỗi.

7 Ứng dụng đột phá của Large Language Models

Large Language Models đã và đang cách mạng hóa nhiều lĩnh vực, từ cách chúng ta tương tác với máy tính đến cách chúng ta tạo ra nội dung và xử lý thông tin.

1. Tối ưu hóa SEO và Sáng tạo nội dung

Large Language Models là công cụ mạnh mẽ hỗ trợ các chuyên gia SEO và người sáng tạo nội dung, giúp cải thiện hiệu suất tìm kiếm và tối ưu hóa quy trình làm việc.

- Nghiên cứu từ khóa và ý định tìm kiếm:

- Phân tích các truy vấn tìm kiếm tự nhiên để xác định ý định người dùng (informative, transactional, navigational).

- Đề xuất các từ khóa dài (long-tail keywords) và các chủ đề liên quan mà con người có thể bỏ sót.

- Xác định các lỗ hổng nội dung (content gaps) so với đối thủ cạnh tranh.

- Xây dựng dàn ý và tạo nội dung:

- Tạo dàn ý bài viết chi tiết, bao gồm các tiêu đề H2, H3, và các điểm chính cần đề cập.

- Viết bản nháp đầu tiên của bài viết, mô tả sản phẩm, meta description, tiêu đề, và FAQ.

- Tối ưu hóa nội dung hiện có để nâng cao khả năng trả lời các câu hỏi cụ thể và đáp ứng ý định tìm kiếm.

- Tóm tắt và viết lại nội dung:

- Tạo bản tóm tắt ngắn gọn của các bài viết dài, giúp người đọc nắm bắt thông tin nhanh chóng và hỗ trợ việc tạo các đoạn giới thiệu hấp dẫn.

- Viết lại nội dung theo các phong cách khác nhau (ví dụ: chuyên nghiệp, thân thiện, SEO-friendly) hoặc để tránh trùng lặp.

- Phân tích ngữ nghĩa và liên kết thực thể (Entity Linking):

- Giúp xác định các thực thể chính trong nội dung và đảm bảo chúng được liên kết ngữ nghĩa với các khái niệm liên quan, hỗ trợ Google hiểu sâu hơn về chủ đề.

- Phân tích cấu trúc ngữ nghĩa của các trang đối thủ để tìm ra các thực thể mà họ đề cập nhưng trang của bạn còn thiếu.

- Tối ưu hóa cho AI Overview / Featured Snippet:

- Viết nội dung dưới dạng câu hỏi-trả lời trực tiếp, rõ ràng, ngắn gọn để tăng khả năng xuất hiện trong AI Overview hoặc Featured Snippet.

- Cấu trúc thông tin theo danh sách, bảng biểu, đoạn văn bản súc tích để dễ dàng trích xuất.

2. Phát triển chatbot và trợ lý ảo

Large Language Models là nền tảng cho sự phát triển của các chatbot và trợ lý ảo có khả năng tương tác gần như con người.

- Tương tác tự nhiên: Cho phép người dùng giao tiếp bằng ngôn ngữ tự nhiên mà không cần tuân theo các lệnh hoặc cấu trúc cứng nhắc.

- Hiểu ý định người dùng: Phân tích các câu hỏi và yêu cầu của người dùng để xác định ý định thực sự, ngay cả khi câu từ không rõ ràng.

- Cá nhân hóa trải nghiệm: Cung cấp thông tin và hỗ trợ phù hợp với ngữ cảnh, lịch sử tương tác và sở thích của từng người dùng.

- Hỗ trợ khách hàng 24/7: Giải đáp thắc mắc, xử lý yêu cầu cơ bản, hướng dẫn sử dụng sản phẩm/dịch vụ, giảm tải cho đội ngũ hỗ trợ con người.

- Trợ lý sáng tạo: Hỗ trợ viết email, lên lịch cuộc họp, tóm tắt tài liệu, và thực hiện các nhiệm vụ hành chính khác.

3. Dịch thuật và tóm tắt tự động

Large Language Models đã nâng cao đáng kể chất lượng và hiệu quả của các công cụ dịch thuật và tóm tắt.

- Dịch thuật chất lượng cao: Tạo ra các bản dịch tự nhiên, ngữ pháp đúng và truyền tải chính xác sắc thái ý nghĩa của văn bản gốc trên nhiều cặp ngôn ngữ.

- Dịch thuật đa ngôn ngữ: Hỗ trợ dịch giữa nhiều ngôn ngữ khác nhau, từ các ngôn ngữ phổ biến đến các ngôn ngữ ít được biết đến hơn.

- Tóm tắt tài liệu dài: Chưng cất các bài báo khoa học, báo cáo tài chính, tài liệu pháp lý thành các bản tóm tắt ngắn gọn, nắm bắt các ý chính mà không làm mất đi thông tin quan trọng.

- Trích xuất thông tin chính: Nhanh chóng nhận diện và trích xuất các thông tin quan trọng như tên, địa điểm, ngày tháng, sự kiện từ các văn bản phi cấu trúc.

4. Phân tích dữ liệu và ra quyết định

Large Language Models có khả năng xử lý và phân tích dữ liệu văn bản phi cấu trúc, biến chúng thành thông tin có giá trị cho việc ra quyết định.

- Phân tích cảm xúc (Sentiment Analysis): Đánh giá thái độ (tích cực, tiêu cực, trung lập) của khách hàng từ các bình luận, đánh giá, bài đăng trên mạng xã hội, giúp doanh nghiệp hiểu được phản ứng của thị trường.

- Trích xuất thông tin: Tự động hóa việc trích xuất các dữ liệu cụ thể (tên sản phẩm, giá cả, đặc điểm kỹ thuật) từ các tài liệu lớn, hợp đồng, email.

- Phát hiện xu hướng và mẫu: Phân tích lượng lớn dữ liệu văn bản để nhận diện các xu hướng mới nổi, sở thích của khách hàng, hoặc các vấn đề tiềm ẩn.

- Hỗ trợ ra quyết định kinh doanh: Cung cấp các phân tích nhanh chóng từ dữ liệu thị trường, báo cáo tài chính, hoặc phản hồi khách hàng để hỗ trợ các quyết định chiến lược.

5. Giáo dục và đào tạo

Large Language Models mang lại tiềm năng lớn trong việc cá nhân hóa và cải thiện trải nghiệm học tập.

- Gia sư cá nhân hóa: Cung cấp giải thích, ví dụ, và bài tập phù hợp với tốc độ và phong cách học của từng học sinh.

- Tạo nội dung giáo dục: Tự động tạo câu hỏi trắc nghiệm, bài tập, kế hoạch bài giảng, và tài liệu học tập dựa trên giáo trình hoặc chủ đề cụ thể.

- Hỗ trợ nghiên cứu và viết luận: Giúp học sinh tìm kiếm thông tin, tóm tắt tài liệu, kiểm tra ngữ pháp và cú pháp, và đưa ra các gợi ý để cải thiện bài viết.

- Học ngôn ngữ: Cung cấp các công cụ luyện tập hội thoại, sửa lỗi ngữ pháp và phát âm, dịch thuật tức thì để hỗ trợ người học ngôn ngữ mới.

6. Phát triển phần mềm và tạo mã

Large Language Models đang trở thành trợ thủ đắc lực cho các nhà phát triển phần mềm, tăng cường năng suất và tự động hóa các tác vụ lặp đi lặp lại.

- Tạo mã nguồn: Sinh ra các đoạn mã, hàm, hoặc toàn bộ ứng dụng dựa trên mô tả ngôn ngữ tự nhiên của nhà phát triển.

- Gỡ lỗi (Debugging): Phân tích mã nguồn và báo cáo lỗi để tìm ra nguyên nhân và đề xuất các giải pháp khắc phục.

- Giải thích mã: Diễn giải các đoạn mã phức tạp, giúp các nhà phát triển hiểu nhanh hơn về code của người khác hoặc các dự án cũ.

- Tự động hóa tài liệu: Sinh ra tài liệu API, hướng dẫn sử dụng, và ghi chú phát hành từ mã nguồn.

- Chuyển đổi ngôn ngữ lập trình: Chuyển đổi mã từ ngôn ngữ này sang ngôn ngữ khác.

7. Y tế và nghiên cứu khoa học

Trong y tế và nghiên cứu khoa học, Large Language Models đang mở ra những khả năng mới trong việc xử lý thông tin phức tạp và hỗ trợ ra quyết định.

- Phân tích y văn khổng lồ: Đọc và tóm tắt hàng triệu bài báo y khoa, nghiên cứu lâm sàng, giúp các nhà khoa học và bác sĩ cập nhật thông tin mới nhất một cách nhanh chóng.

- Hỗ trợ chẩn đoán: Phân tích dữ liệu bệnh án, triệu chứng, lịch sử y tế của bệnh nhân để đề xuất các chẩn đoán tiềm năng và phác đồ điều trị (chỉ là công cụ hỗ trợ, không thay thế bác sĩ).

- Khám phá thuốc: Hỗ trợ trong giai đoạn đầu của việc khám phá thuốc bằng cách phân tích các hợp chất, tương tác protein, và dữ liệu thử nghiệm.

- Cá nhân hóa y học: Đề xuất các phương pháp điều trị và lời khuyên sức khỏe dựa trên hồ sơ gen, lịch sử bệnh lý, và lối sống của từng bệnh nhân.

- Quản lý hồ sơ bệnh án điện tử (EHR): Tự động trích xuất thông tin quan trọng từ các ghi chú lâm sàng phi cấu trúc để cải thiện việc quản lý dữ liệu.

Thách thức chính của Large Language Models

Mặc dù mang lại nhiều lợi ích, Large Language Models cũng đối mặt với những thách thức đáng kể cần được giải quyết để khai thác tối đa tiềm năng của chúng một cách an toàn và hiệu quả.

Sai lệch và thông tin không chính xác

- Hiện tượng Hallucination: Đây là một trong những thách thức nghiêm trọng nhất. LLM có thể tạo ra thông tin nghe có vẻ hợp lý nhưng hoàn toàn sai lệch hoặc không có căn cứ thực tế.

- Nguyên nhân: Mô hình được huấn luyện để dự đoán từ tiếp theo dựa trên các mẫu trong dữ liệu, không phải để truy xuất sự thật. Khi không có đủ thông tin để đưa ra câu trả lời chính xác, mô hình có thể “bịa đặt” một cách thuyết phục.

- Hậu quả: Gây mất lòng tin, dẫn đến việc lan truyền thông tin sai lệch, và có thể có những tác động tiêu cực nghiêm trọng trong các lĩnh vực nhạy cảm như y tế, pháp luật.

- Dữ liệu lỗi thời: LLM thường bị giới hạn bởi dữ liệu huấn luyện của chúng. Thông tin mới hoặc các sự kiện gần đây có thể không có trong kho dữ liệu, dẫn đến phản hồi lỗi thời hoặc không liên quan.

Vấn đề đạo đức và quyền riêng tư

- Thiên vị (Bias): LLM học từ dữ liệu do con người tạo ra, và do đó kế thừa các thành kiến xã hội, định kiến giới tính, chủng tộc có trong dữ liệu đó.

- Hậu quả: Có thể tạo ra nội dung phân biệt đối xử, không công bằng, hoặc thiếu nhạy cảm.

- Ví dụ: Gợi ý nghề nghiệp thiên vị giới tính hoặc chủng tộc.

- Quyền riêng tư: Dữ liệu huấn luyện của LLM có thể chứa thông tin cá nhân nhạy cảm. Mặc dù các mô hình được thiết kế để không tái tạo chính xác dữ liệu gốc, vẫn có rủi ro về việc rò rỉ hoặc ghi nhớ thông tin cá nhân.

- Sử dụng sai mục đích: LLM có thể bị lợi dụng để tạo ra nội dung độc hại (tin giả, lừa đảo, phát tán thông tin sai lệch), làm giả giọng điệu (deepfakes), hoặc tự động hóa các cuộc tấn công mạng.

- Vấn đề bản quyền: Việc LLM sử dụng dữ liệu từ internet để huấn luyện đặt ra câu hỏi về bản quyền của nội dung gốc. Nội dung do LLM tạo ra có thể trùng lặp hoặc phái sinh từ các tác phẩm có bản quyền.

Chi phí vận hành và tài nguyên tính toán

- Chi phí huấn luyện khổng lồ: Huấn luyện một LLM từ đầu đòi hỏi sức mạnh tính toán cực lớn (hàng nghìn GPU trong nhiều tháng) và tiêu tốn hàng triệu đô la năng lượng và tài nguyên phần cứng.

- Chi phí suy luận (Inference cost): Ngay cả khi đã được huấn luyện, việc chạy LLM để tạo ra phản hồi (suy luận) vẫn tốn kém tài nguyên tính toán và năng lượng, đặc biệt với các mô hình lớn và khi xử lý lượng truy vấn cao.

- Hạn chế tiếp cận: Chi phí cao này tạo ra rào cản lớn cho các tổ chức nhỏ hơn hoặc các nhà nghiên cứu độc lập muốn phát triển hoặc tùy chỉnh LLM.

Thiếu khả năng giải thích và minh bạch

- Tính chất “Black Box”: Do cấu trúc phức tạp với hàng tỷ tham số, rất khó để hiểu chính xác cách LLM đưa ra một quyết định hoặc tạo ra một phản hồi cụ thể.

- Hậu quả: Thiếu khả năng giải thích (explainability) gây khó khăn trong việc gỡ lỗi, kiểm soát, và đảm bảo sự công bằng của mô hình.

- Niềm tin: Người dùng và các bên liên quan có thể khó tin tưởng vào các hệ thống mà họ không thể hiểu được cách chúng hoạt động.

- Khó xác định trách nhiệm: Khi LLM đưa ra thông tin sai lệch hoặc gây hại, việc xác định trách nhiệm pháp lý trở nên phức tạp do tính chất không minh bạch của chúng.

Tương lai của Large Language Models và vai trò trong SEO

Tương lai của LLM hứa hẹn nhiều bước tiến đột phá, đồng thời định hình lại hoàn toàn cách thức hoạt động của tìm kiếm và tối ưu hóa SEO.

Xu hướng phát triển công nghệ

- Đa phương thức (Multimodality): LLM sẽ không chỉ giới hạn ở văn bản mà còn tích hợp hiểu và tạo ra các loại dữ liệu khác như hình ảnh, âm thanh, video. Điều này cho phép chúng xử lý các truy vấn phức tạp hơn và tạo ra trải nghiệm người dùng phong phú hơn. Ví dụ: Gemini của Google, GPT-4V của OpenAI.

- Hiệu suất cao hơn, kích thước nhỏ hơn: Các nhà nghiên cứu đang tập trung vào việc tạo ra các mô hình nhỏ hơn, hiệu quả hơn nhưng vẫn giữ được năng lực của các LLM lớn. Điều này giúp giảm chi phí vận hành, tăng tốc độ suy luận và cho phép triển khai trên các thiết bị biên (edge devices).

- Khả năng lập luận và giải quyết vấn đề: LLM sẽ được cải thiện về khả năng suy luận logic, giải quyết các vấn đề phức tạp và thực hiện các nhiệm vụ đòi hỏi nhiều bước tư duy hơn.

- Tích hợp dữ liệu thời gian thực: Khả năng truy cập và xử lý thông tin mới nhất từ internet sẽ giúp LLM vượt qua hạn chế về dữ liệu huấn luyện lỗi thời, cung cấp các phản hồi chính xác và cập nhật hơn.

- AI Agentic (Tác nhân AI): Các LLM sẽ hoạt động như các “agent” tự chủ, có khả năng lên kế hoạch, thực hiện chuỗi hành động, tương tác với các công cụ bên ngoài và điều chỉnh hành vi dựa trên phản hồi.

- Cải thiện tính minh bạch và kiểm soát: Nghiên cứu về “explainable AI” (XAI) sẽ giúp tăng cường khả năng giải thích của LLM, cho phép người dùng hiểu rõ hơn về cách mô hình đưa ra quyết định.

LLM định hình lại tìm kiếm và SEO như thế nào?

LLM đang thay đổi cách Google và các công cụ tìm kiếm khác hiểu và hiển thị thông tin, kéo theo những thay đổi lớn trong chiến lược SEO.

- Search Generative Experience (SGE) và AI Overviews:

- Google đã giới thiệu SGE (nay là AI Overviews), nơi LLM tạo ra các bản tóm tắt và câu trả lời trực tiếp cho các truy vấn phức tạp ngay trên trang kết quả tìm kiếm (SERP).

- Tác động đến SEO: Điều này có nghĩa là người dùng có thể nhận được câu trả lời mà không cần nhấp vào các liên kết website truyền thống. SEO sẽ cần tập trung vào việc tạo nội dung có cấu trúc rõ ràng, trả lời trực diện các câu hỏi để được trích xuất vào AI Overview.

- Thách thức: Khuyến khích người dùng nhấp vào trang web của bạn sau khi họ đã nhận được câu trả lời từ AI Overview sẽ trở thành một thách thức mới.

- MUM (Multitask Unified Model):

- MUM là một mô hình dựa trên Transformer của Google, có khả năng hiểu thông tin đa phương thức (văn bản, hình ảnh) và giải quyết các truy vấn phức tạp, đa chiều.

- Tác động đến SEO: MUM giúp Google hiểu sâu hơn về ý định tìm kiếm, ngay cả với các truy vấn dài và phức tạp. SEO sẽ cần tạo ra nội dung toàn diện, kết nối các chủ đề liên quan và cung cấp câu trả lời chi tiết cho các “câu hỏi phụ” mà người dùng có thể có.

- RankBrain:

- RankBrain là hệ thống AI dựa trên Machine Learning của Google, được sử dụng để giải thích các truy vấn tìm kiếm và xếp hạng các kết quả phù hợp nhất. Nó đặc biệt hữu ích cho các truy vấn chưa từng thấy trước đây.

- Tác động đến SEO: RankBrain nhấn mạnh tầm quan trọng của ngữ cảnh và ngữ nghĩa. Nội dung cần phải được tối ưu hóa cho các thực thể và chủ đề liên quan, không chỉ các từ khóa riêng lẻ.

- E-E-A-T (Experience, Expertise, Authoritativeness, Trustworthiness):

- E-E-A-T là một bộ nguyên tắc quan trọng mà Google sử dụng để đánh giá chất lượng và độ tin cậy của nội dung.

- Experience (Kinh nghiệm): Nội dung thể hiện kinh nghiệm thực tế.

- Expertise (Chuyên môn): Nội dung được tạo bởi người có chuyên môn trong lĩnh vực.

- Authoritativeness (Thẩm quyền): Nội dung và tác giả được công nhận là nguồn đáng tin cậy.

- Trustworthiness (Độ tin cậy): Nội dung chính xác, trung thực và không gây hiểu lầm.

- Vai trò của LLM và SEO: Trong bối cảnh AI tạo sinh, E-E-A-T trở nên quan trọng hơn bao giờ hết. Google muốn đảm bảo rằng các nguồn mà AI Overviews trích dẫn là đáng tin cậy.

- LLM có thể hỗ trợ tạo ra nội dung có cấu trúc tốt, nghiên cứu sâu.

- Tuy nhiên, yếu tố “Experience” và “Trustworthiness” vẫn đòi hỏi sự đóng góp của con người. Các chuyên gia SEO cần đảm bảo nội dung do AI tạo ra được kiểm duyệt, chỉnh sửa và bổ sung bởi những người có kinh nghiệm thực tế và chuyên môn.

- Việc xây dựng thương hiệu cá nhân, trích dẫn nguồn đáng tin cậy, và minh bạch về tác giả sẽ càng quan trọng.

- Dịch chuyển từ từ khóa sang thực thể và ý định:

- Công cụ tìm kiếm đang ngày càng hiểu thế giới thông qua các thực thể (entities) và mối quan hệ ngữ nghĩa giữa chúng, hơn là chỉ dựa vào từ khóa.

- SEO sẽ tập trung vào việc bao phủ chủ đề một cách toàn diện, xây dựng authority cho các thực thể liên quan đến doanh nghiệp và ngành nghề.

- Tối ưu hóa Semantic SEO:

- Semantic SEO (SEO ngữ nghĩa) sẽ là trọng tâm. Điều này có nghĩa là tạo nội dung không chỉ chứa các từ khóa mà còn bao phủ toàn bộ mạng lưới ngữ nghĩa xung quanh một chủ đề, trả lời tất cả các câu hỏi liên quan và cung cấp ngữ cảnh đầy đủ.

- Việc sử dụng Schema Markup để giúp công cụ tìm kiếm hiểu rõ hơn về nội dung và các thực thể trên trang sẽ càng trở nên cần thiết.

Câu hỏi thường gặp về Large Language Models

LLM khác gì so với mô hình NLP truyền thống?

LLM khác biệt so với mô hình NLP truyền thống ở nhiều khía cạnh chính:

- Quy mô: LLM có số lượng tham số khổng lồ (từ hàng tỷ đến hàng nghìn tỷ), trong khi mô hình NLP truyền thống nhỏ hơn nhiều.

- Dữ liệu huấn luyện: LLM được huấn luyện trên lượng dữ liệu văn bản khổng lồ, đa dạng từ internet, còn mô hình truyền thống thường dùng tập dữ liệu nhỏ hơn, chuyên biệt.

- Kiến trúc: Hầu hết LLM sử dụng kiến trúc Transformer với cơ chế self-attention, cho phép hiểu ngữ cảnh rộng và xử lý song song. Mô hình truyền thống thường dùng RNN, LSTM hoặc các kỹ thuật thống kê.

- Khả năng tổng quát hóa: LLM có khả năng tổng quát hóa tốt hơn nhiều, có thể thực hiện nhiều nhiệm vụ khác nhau (tạo văn bản, dịch, tóm tắt) sau khi pre-training mà không cần huấn luyện lại từ đầu cho từng nhiệm vụ. Mô hình truyền thống thường chuyên biệt cho một nhiệm vụ.

- Hiệu suất: LLM thường đạt hiệu suất vượt trội trên hầu hết các tác vụ NLP so với các mô hình truyền thống.

Có những loại kiến trúc LLM phổ biến nào?

Các kiến trúc LLM phổ biến hiện nay chủ yếu dựa trên Transformer và có ba loại chính:

- Encoder-only (ví dụ: BERT, RoBERTa):

- Chỉ sử dụng phần Encoder của kiến trúc Transformer.

- Được thiết kế để hiểu văn bản hai chiều (bidirectional), tức là xem xét cả ngữ cảnh trước và sau một từ.

- Tuyệt vời cho các nhiệm vụ hiểu ngôn ngữ như phân loại văn bản, nhận dạng thực thể có tên, trả lời câu hỏi dựa trên đoạn văn.

- Decoder-only (ví dụ: GPT-3, GPT-4, LLaMA):

- Chỉ sử dụng phần Decoder của kiến trúc Transformer.

- Được thiết kế để sinh văn bản tuần tự (auto-regressive), dự đoán từ tiếp theo dựa trên các từ đã tạo trước đó.

- Rất mạnh mẽ trong các nhiệm vụ tạo văn bản như viết bài, hội thoại, dịch thuật.

- Encoder-Decoder (ví dụ: T5, BART):

- Sử dụng cả phần Encoder và Decoder.

- Encoder xử lý văn bản đầu vào và Decoder tạo ra văn bản đầu ra.

- Lý tưởng cho các nhiệm vụ yêu cầu cả hiểu và tạo như dịch máy, tóm tắt, trả lời câu hỏi phức tạp.

Làm thế nào để đánh giá hiệu suất của một LLM?

Đánh giá hiệu suất của một LLM là một quá trình phức tạp, thường kết hợp cả các số liệu tự động và đánh giá của con người:

- Số liệu tự động:

- Perplexity: Đo lường mức độ “ngạc nhiên” của mô hình trước một chuỗi văn bản. Giá trị thấp hơn cho thấy mô hình dự đoán tốt hơn.

- BLEU (Bilingual Evaluation Understudy): Thường dùng cho dịch máy, so sánh bản dịch của mô hình với bản dịch của con người.

- ROUGE (Recall-Oriented Understudy for Gisting Evaluation): Thường dùng cho tóm tắt, đo mức độ chồng chéo giữa bản tóm tắt của mô hình và bản tóm tắt tham chiếu.

- F1-score, Precision, Recall: Cho các nhiệm vụ phân loại hoặc trích xuất thông tin.

- Đánh giá của con người:

- Chất lượng tổng thể: Con người đánh giá sự mạch lạc, ngữ pháp, tính tự nhiên, và sự phù hợp của văn bản được tạo ra.

- Tính hữu ích/độ chính xác: Đánh giá mức độ hữu ích và chính xác của câu trả lời hoặc nội dung được tạo.

- Tính an toàn/đạo đức: Kiểm tra xem mô hình có tạo ra nội dung thiên vị, độc hại, hoặc không phù hợp không.

- Benchmarking (Bộ tiêu chuẩn đánh giá): Sử dụng các bộ dữ liệu và tác vụ tiêu chuẩn (ví dụ: GLUE, SuperGLUE, MMLU) để so sánh hiệu suất của các mô hình khác nhau.

LLM có thể thay thế hoàn toàn con người trong ngành SEO không?

Không, Large Language Models không thể thay thế hoàn toàn con người trong ngành SEO. Thay vào đó, chúng là những công cụ mạnh mẽ hỗ trợ và nâng cao hiệu suất của các chuyên gia SEO.

- Điểm mạnh của LLM trong SEO:

- Tạo nội dung nhanh chóng (bản nháp, tiêu đề, mô tả).

- Nghiên cứu từ khóa, phân tích đối thủ, tổng hợp thông tin.

- Tối ưu hóa kỹ thuật (đề xuất cấu trúc URL, Schema Markup).

- Phân tích dữ liệu lớn để tìm kiếm xu hướng.

- Hạn chế của LLM trong SEO (và vai trò không thể thay thế của con người):

- E-E-A-T (Experience, Expertise, Authoritativeness, Trustworthiness): LLM thiếu kinh nghiệm thực tế và khả năng xây dựng uy tín. Con người cần cung cấp trải nghiệm độc đáo, chuyên môn sâu, và đảm bảo độ tin cậy.

- Chiến lược và ý định: LLM không có khả năng tự đặt ra chiến lược SEO tổng thể, hiểu sâu sắc về mục tiêu kinh doanh, hoặc điều chỉnh chiến lược dựa trên các thay đổi thị trường phức tạp.

- Sự sáng tạo và đổi mới: Mặc dù LLM có thể tạo ra nội dung “sáng tạo”, nhưng sự đột phá thực sự, các ý tưởng độc đáo và góc nhìn mới mẻ vẫn đến từ con người.

- Đạo đức và sự giám sát: Con người cần kiểm duyệt nội dung do AI tạo ra để đảm bảo tính chính xác, không thiên vị, không vi phạm bản quyền và tuân thủ các nguyên tắc đạo đức.

- Xử lý các tình huống đặc biệt: Các truy vấn phức tạp, đòi hỏi sự đồng cảm, hoặc những tình huống không điển hình vẫn cần sự can thiệp của con người.

Large Language Models giúp tự động hóa các tác vụ tẻ nhạt, giải phóng thời gian cho chuyên gia SEO để tập trung vào chiến lược, sáng tạo và xây dựng mối quan hệ.

Các công ty công nghệ lớn nào đang phát triển LLM?

Hiện nay, nhiều công ty công nghệ lớn đang tích cực nghiên cứu và phát triển Large Language Models, đóng góp vào sự tiến bộ của lĩnh vực này:

- OpenAI: Nổi tiếng với dòng mô hình GPT (Generative Pre-trained Transformer) như GPT-3, GPT-4, GPT-4V, và sản phẩm ứng dụng ChatGPT, DALL-E (mô hình tạo hình ảnh).

- Google (Google AI): Phát triển các mô hình như BERT, T5, PaLM, LaMDA, và gần đây nhất là Gemini – một mô hình đa phương thức cạnh tranh với GPT-4. Google cũng tích hợp LLM vào các sản phẩm của mình như Search Generative Experience (SGE) và Bard.

- Meta (Meta AI): Đã phát triển dòng mô hình LLaMA (Large Language Model Meta AI) và các phiên bản tiếp theo, thường tập trung vào việc cung cấp các mô hình mã nguồn mở cho cộng đồng nghiên cứu.

- Microsoft: Đầu tư mạnh vào OpenAI và tích hợp các mô hình GPT vào các sản phẩm của mình như Bing Chat (Copilot), Microsoft 365 Copilot.

- Anthropic: Được thành lập bởi các cựu thành viên của OpenAI, tập trung vào việc phát triển các mô hình AI an toàn và có trách nhiệm, nổi bật với dòng mô hình Claude.

- Amazon (AWS AI): Cung cấp các dịch vụ LLM thông qua Amazon SageMaker và phát triển các mô hình như Titan.

- Baidu (Trung Quốc): Phát triển LLM của riêng mình như Ernie Bot.

- Stability AI: Nổi tiếng với Stable Diffusion (mô hình tạo hình ảnh), cũng đang nghiên cứu các LLM.

Kết bài

Large Language Models đã chứng minh là một trong những công nghệ đột phá nhất của thời đại chúng ta, định hình lại cách chúng ta tương tác với thông tin và máy tính. Từ khả năng hiểu và tạo ngôn ngữ tự nhiên đến việc ứng dụng rộng rãi trong SEO, chatbot, dịch thuật và nhiều lĩnh vực khác, Large Language Models đang mở ra những chân trời mới. Tuy nhiên, LADIGI Agency nhận thấy rằng cùng với tiềm năng to lớn là những thách thức không nhỏ về thông tin sai lệch, đạo đức và chi phí. Để khai thác tối đa lợi ích mà LLM mang lại, đặc biệt trong tối ưu hóa tìm kiếm, cần có sự kết hợp hài hòa giữa công nghệ AI tiên tiến và chuyên môn, chiến lược của con người, đảm bảo tính chính xác, đáng tin cậy và tuân thủ các nguyên tắc E-E-A-T.

LADIGI Agency cung cấp Dịch vụ SEO chuyên nghiệp, kết hợp chiến lược Semantic SEO và tận dụng tối ưu sức mạnh của AI/LLM để đưa doanh nghiệp của bạn dẫn đầu trong kỷ nguyên tìm kiếm mới.