- Googlebot là trình thu thập dữ liệu của Google, có nhiệm vụ khám phá và lập chỉ mục nội dung web.

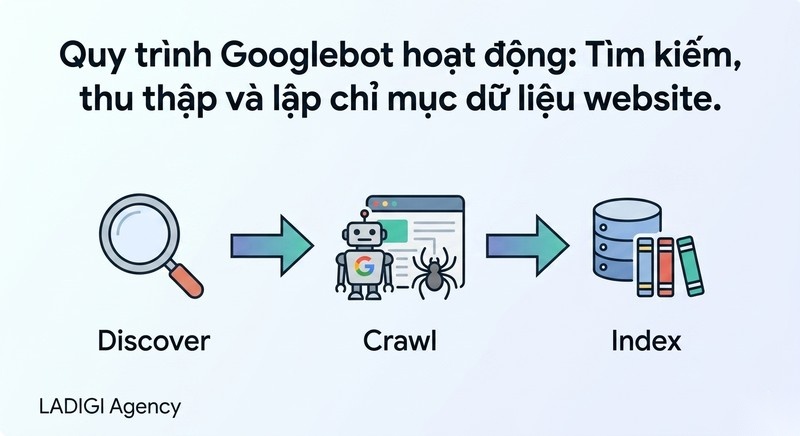

- Cơ chế hoạt động bao gồm tìm kiếm, thu thập dữ liệu (crawling), xử lý, phân tích và lập chỉ mục (indexing) các trang web.

- Tầm quan trọng của Googlebot quyết định khả năng hiển thị, xếp hạng và nhận diện website trên công cụ tìm kiếm.

- Tốc độ thu thập dữ liệu có thể chậm do ngân sách thu thập (Crawl Budget) hạn chế, tốc độ máy chủ kém hoặc cấu trúc website phức tạp.

- Tối ưu hóa cho Googlebot giúp đảm bảo nội dung được tìm thấy, hiểu và xếp hạng tốt hơn, cải thiện hiệu suất SEO tổng thể.

- Các biện pháp khắc phục các vấn đề phổ biến bao gồm sử dụng Google Search Console, tối ưu robots.txt và tăng cường tốc độ tải trang.

Sau khi đã nắm được tổng quan về Googlebot và vai trò thiết yếu của nó, LADIGI Agency hiểu rằng việc tối ưu hóa website cho trình thu thập này là chìa khóa để đạt được thứ hạng cao trên công cụ tìm kiếm. Từ những điểm chính trên, bài viết này sẽ đi sâu vào từng khía cạnh, từ cơ chế hoạt động cho đến các chiến lược tối ưu hiệu quả nhất, giúp bạn xây dựng một website thân thiện với Googlebot và tối đa hóa khả năng hiển thị.

Googlebot là gì?

Googlebot là tên gọi chung cho các chương trình thu thập dữ liệu (web crawler, spider, bot) mà Google sử dụng để khám phá, thu thập thông tin và lập chỉ mục các trang web trên internet. Mục tiêu chính của Googlebot là tạo ra một bản sao toàn diện của internet, giúp Google có thể cung cấp các kết quả tìm kiếm phù hợp và cập nhật cho người dùng.

Các loại Googlebot chính bao gồm:

- Googlebot Smartphone: Thu thập dữ liệu để hiển thị kết quả tìm kiếm trên thiết bị di động. Đây là trình thu thập chính từ khi Google chuyển sang lập chỉ mục ưu tiên di động (mobile-first indexing).

- Googlebot Desktop: Thu thập dữ liệu để hiển thị kết quả tìm kiếm trên máy tính để bàn.

- Googlebot Image: Thu thập hình ảnh cho Google Images.

- Googlebot Video: Thu thập video cho Google Videos.

- Googlebot News: Thu thập nội dung tin tức cho Google News.

- AdsBot: Thu thập dữ liệu để xác minh chất lượng trang đích quảng cáo.

Mỗi loại Googlebot có một user-agent riêng biệt, nhưng chúng đều hoạt động dưới tên chung là “Googlebot”. Sự hiện diện của Googlebot trên website là dấu hiệu cho thấy trang của bạn đang được Google xem xét để đưa vào chỉ mục tìm kiếm.

Cơ chế hoạt động của Googlebot

Cơ chế hoạt động của Googlebot là một quá trình phức tạp nhưng logic, đảm bảo Google có thể thu thập và xử lý hàng tỷ trang web một cách hiệu quả. Quá trình này có thể được chia thành các giai đoạn chính:

Tìm kiếm và khám phá trang web

Googlebot bắt đầu hành trình khám phá các trang web mới hoặc các bản cập nhật của các trang web đã biết. Các nguồn chính để Googlebot tìm thấy URL bao gồm:

- Liên kết từ các trang web đã biết: Đây là phương pháp phổ biến nhất. Googlebot theo dõi các liên kết (internal links và external links) từ các trang web mà nó đã lập chỉ mục.

- Sitemap (Sơ đồ trang web): Các tệp XML Sitemap mà chủ website gửi lên Google Search Console cung cấp một danh sách các URL cần được thu thập và mức độ ưu tiên của chúng.

- URL Submission (Gửi URL thủ công): Chủ website có thể yêu cầu Google thu thập một URL cụ thể thông qua Google Search Console.

- Các nguồn khác: Googlebot cũng có thể khám phá URL từ các nguồn như RSS feeds, công cụ phân tích lưu lượng truy cập hoặc dữ liệu người dùng.

Quá trình này không ngừng diễn ra, với Googlebot liên tục cập nhật danh sách các URL cần truy cập và thu thập.

Quá trình thu thập dữ liệu

Sau khi một URL được khám phá, Googlebot sẽ thực hiện việc thu thập dữ liệu (crawling). Giai đoạn này bao gồm:

- Gửi yêu cầu HTTP: Googlebot gửi yêu cầu đến máy chủ của trang web để lấy nội dung của URL đó.

- Đọc tệp robots.txt: Trước khi truy cập bất kỳ trang nào, Googlebot sẽ kiểm tra tệp

robots.txttrong thư mục gốc của website. Tệp này chứa các chỉ dẫn về những phần nào của website Googlebot được phép hoặc không được phép truy cập. - Tải xuống nội dung trang: Nếu không bị

robots.txtchặn, Googlebot sẽ tải xuống toàn bộ mã nguồn của trang, bao gồm HTML, CSS, JavaScript, hình ảnh, video và các tài nguyên khác. - Phân tích và trích xuất liên kết: Googlebot sau đó phân tích nội dung đã tải xuống để tìm kiếm các liên kết mới hoặc liên kết đến các trang chưa được thu thập. Các liên kết này sẽ được thêm vào hàng đợi để Googlebot khám phá trong tương lai.

- Tần suất thu thập: Googlebot không truy cập mọi trang mỗi ngày. Tần suất thu thập dữ liệu phụ thuộc vào nhiều yếu tố như tần suất cập nhật nội dung, chất lượng trang, mức độ phổ biến và “ngân sách thu thập dữ liệu” (Crawl Budget) được cấp cho website.

Quá trình crawling là bước đầu tiên để Google có thể “đọc” và hiểu nội dung trên website.

Xử lý và phân tích dữ liệu

Sau khi thu thập dữ liệu, Googlebot không chỉ đơn thuần lưu trữ mã nguồn. Thay vào đó, nó chuyển dữ liệu này sang các hệ thống xử lý phức tạp của Google để phân tích sâu. Giai đoạn này bao gồm:

- Phân tích ngữ nghĩa (Semantic Analysis): Google cố gắng hiểu ý nghĩa của nội dung trên trang, xác định các thực thể (entities) như người, địa điểm, sự vật, khái niệm và mối quan hệ giữa chúng. Điều này giúp Google xây dựng biểu đồ tri thức (Knowledge Graph) và trả lời các truy vấn tìm kiếm phức tạp.

- Trích xuất từ khóa và chủ đề: Các thuật toán phân tích ngôn ngữ tự nhiên (NLP) được sử dụng để xác định các từ khóa chính, chủ đề và ý định tìm kiếm mà trang có thể đáp ứng.

- Đánh giá chất lượng nội dung: Google đánh giá chất lượng, độ độc đáo, độ tin cậy và mức độ chuyên sâu của nội dung. Nội dung trùng lặp hoặc chất lượng thấp có thể bị bỏ qua hoặc xếp hạng thấp.

- Phân tích cấu trúc trang: Google phân tích cấu trúc HTML của trang, bao gồm các thẻ tiêu đề (H1, H2), đoạn văn, danh sách, bảng, và cách bố trí nội dung. Cấu trúc rõ ràng giúp Google hiểu được hệ thống phân cấp thông tin.

- Xử lý JavaScript và CSS: Đối với các trang web hiện đại sử dụng nhiều JavaScript để hiển thị nội dung, Googlebot có khả năng render (kết xuất) trang giống như một trình duyệt web thông thường để thấy được nội dung cuối cùng mà người dùng nhìn thấy. Điều này đảm bảo rằng nội dung được tạo ra bởi JavaScript không bị bỏ lỡ.

Quá trình này cho phép Google không chỉ “đọc” mà còn “hiểu” được nội dung của website, chuẩn bị cho bước lập chỉ mục.

Lập chỉ mục trang web

Giai đoạn lập chỉ mục là nơi mà các thông tin đã được thu thập và phân tích được lưu trữ vào cơ sở dữ liệu khổng lồ của Google, gọi là chỉ mục (Index).

- Lưu trữ dữ liệu có cấu trúc: Tất cả thông tin quan trọng về trang (bao gồm các từ khóa, thực thể, chủ đề, cấu trúc, và các tín hiệu chất lượng khác) được lưu trữ trong một cấu trúc dữ liệu tối ưu hóa cho tìm kiếm.

- Tạo bản đồ chỉ mục: Google tạo ra một “bản đồ” hoặc “chỉ mục” chi tiết cho mỗi trang, liên kết nội dung với các truy vấn tìm kiếm tiềm năng. Khi người dùng tìm kiếm, Google sẽ truy vấn chỉ mục này để tìm các trang phù hợp nhất.

- Xếp hạng sẵn sàng: Một khi trang được lập chỉ mục, nó đã sẵn sàng để xuất hiện trong kết quả tìm kiếm. Tuy nhiên, việc xuất hiện ở đâu (thứ hạng) còn phụ thuộc vào hàng trăm yếu tố xếp hạng khác.

- Cập nhật chỉ mục: Google liên tục cập nhật chỉ mục của mình. Khi nội dung trên một trang thay đổi hoặc một trang mới được khám phá, Googlebot sẽ thu thập lại và cập nhật thông tin trong chỉ mục.

Việc một trang được lập chỉ mục là điều kiện tiên quyết để nó có thể được tìm thấy trên Google. Nếu một trang không được lập chỉ mục, nó hoàn toàn vô hình đối với công cụ tìm kiếm.

Tầm quan trọng của Googlebot đối với website

Googlebot là yếu tố trung tâm trong việc định hình sự hiện diện trực tuyến của một website. Vai trò của nó không chỉ đơn thuần là thu thập dữ liệu mà còn ảnh hưởng trực tiếp đến khả năng hiển thị, xếp hạng và thành công của một chiến lược SEO.

Ảnh hưởng đến khả năng hiển thị tìm kiếm

- Điều kiện tiên quyết để xuất hiện: Nếu Googlebot không thể truy cập, thu thập dữ liệu và lập chỉ mục một trang, trang đó sẽ không bao giờ xuất hiện trong kết quả tìm kiếm của Google. Đây là bước đầu tiên và quan trọng nhất để website có thể được người dùng tìm thấy thông qua công cụ tìm kiếm.

- Đảm bảo nội dung mới được phát hiện: Đối với các website thường xuyên cập nhật nội dung (blog, tin tức, thương mại điện tử), Googlebot cần truy cập thường xuyên để phát hiện các bài viết, sản phẩm mới. Điều này đảm bảo rằng thông tin mới nhất của bạn sẽ được hiển thị cho người dùng.

- Cập nhật thông tin chính xác: Khi bạn sửa đổi nội dung hiện có, Googlebot cần thu thập lại trang đó để cập nhật thông tin trong chỉ mục của Google. Nếu Googlebot thu thập chậm, người dùng có thể thấy thông tin cũ hoặc không chính xác trên kết quả tìm kiếm.

Vai trò trong việc xếp hạng trang web

- Cung cấp dữ liệu cho thuật toán: Googlebot thu thập tất cả các tín hiệu cần thiết cho thuật toán xếp hạng của Google, bao gồm:

- Nội dung: Chất lượng, mức độ liên quan, từ khóa, thực thể.

- Cấu trúc: Thẻ tiêu đề, thẻ meta, liên kết nội bộ, dữ liệu có cấu trúc.

- Hiệu suất: Tốc độ tải trang, trải nghiệm di động.

- Tín hiệu bên ngoài:Backlinks (mặc dù Googlebot không trực tiếp thu thập backlink từ trang của bạn, nó sẽ tìm thấy các trang liên kết đến bạn).

- Đánh giá chất lượng và độ liên quan: Các dữ liệu được Googlebot thu thập giúp Google đánh giá mức độ phù hợp của trang với các truy vấn tìm kiếm khác nhau, cũng như chất lượng tổng thể và độ uy tín của website.

- Ảnh hưởng đến Core Web Vitals: Googlebot đo lường các chỉ số trải nghiệm trang như Tốc độ tải nội dung lớn nhất (LCP), Độ trễ tương tác đầu tiên (FID), và Thay đổi bố cục tích lũy (CLS). Các chỉ số này là yếu tố xếp hạng quan trọng.

Tín hiệu cho thuật toán Google

- Tần suất thu thập dữ liệu: Một website được Googlebot truy cập thường xuyên hơn thường là dấu hiệu của một website có nội dung mới mẻ, chất lượng và được cập nhật định kỳ, hoặc có độ phổ biến cao. Điều này có thể gián tiếp gửi tín hiệu tích cực đến thuật toán.

- Phản ứng của Googlebot với các lỗi: Nếu Googlebot liên tục gặp lỗi khi truy cập website của bạn (ví dụ: lỗi 4xx, 5xx), điều này có thể gửi tín hiệu tiêu cực về độ tin cậy và chất lượng của website, dẫn đến việc giảm tần suất thu thập dữ liệu hoặc thậm chí loại bỏ một số trang khỏi chỉ mục.

- Cách Googlebot xử lý website: Googlebot cũng đánh giá cách website phản ứng. Một website được tối ưu tốt, tải nhanh, và có cấu trúc rõ ràng sẽ giúp Googlebot thu thập dữ liệu hiệu quả hơn, từ đó tăng cơ hội được xếp hạng tốt hơn.

Tóm lại, Googlebot không chỉ là một công cụ mà là cầu nối quan trọng nhất giữa website của bạn và người dùng tìm kiếm trên Google. Việc hiểu và tối ưu hóa cho nó là nền tảng của mọi chiến dịch SEO thành công.

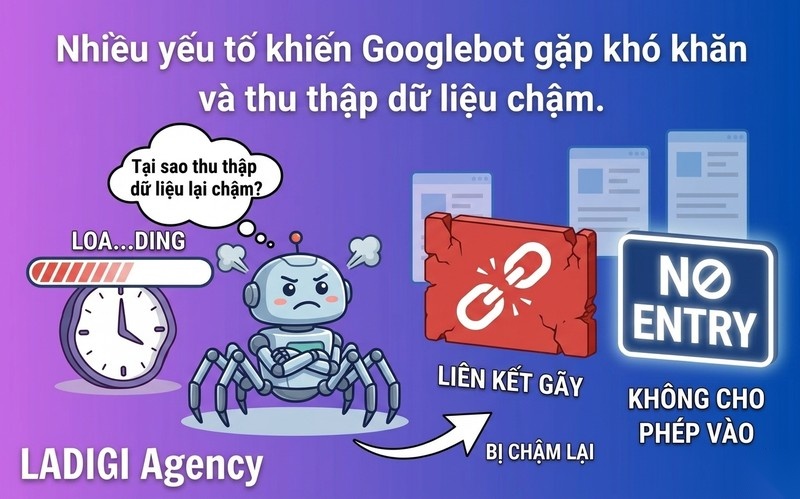

Lý do Googlebot thu thập dữ liệu chậm

Việc Googlebot thu thập dữ liệu chậm có thể ảnh hưởng nghiêm trọng đến khả năng hiển thị và xếp hạng của website. Điều này đồng nghĩa với việc các nội dung mới hoặc cập nhật của bạn sẽ mất nhiều thời gian hơn để xuất hiện trên Google. Dưới đây là các lý do chính:

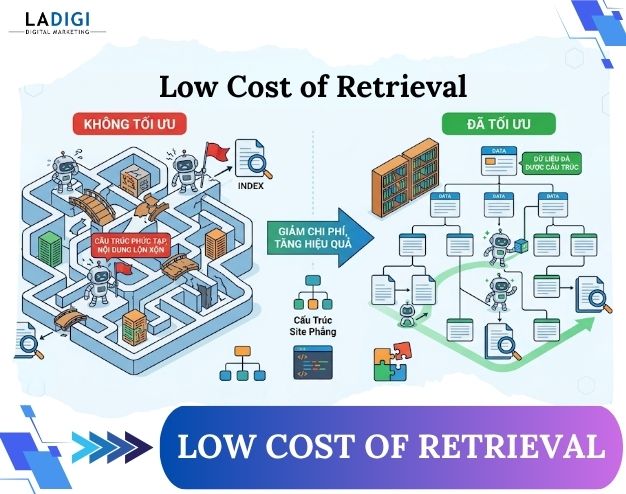

Ngân sách thu thập dữ liệu (Crawl Budget) hạn chế

- Định nghĩa: Crawl Budget là số lượng URL mà Googlebot sẵn sàng và có thể thu thập trên một website trong một khoảng thời gian nhất định. Google không thể thu thập mọi trang trên internet mỗi ngày.

- Yếu tố ảnh hưởng:

- Kích thước website: Các website lớn hơn thường cần Crawl Budget lớn hơn.

- Tần suất cập nhật: Website có nội dung mới thường xuyên sẽ được cấp Crawl Budget cao hơn.

- Uy tín (Authority) của website: Các website có độ uy tín cao, nhiều backlink chất lượng thường được ưu tiên thu thập.

- Lỗi máy chủ/lỗi trang: Các lỗi này làm lãng phí Crawl Budget, khiến Googlebot dành thời gian xử lý lỗi thay vì thu thập nội dung có giá trị.

- Trang chất lượng thấp/trùng lặp: Googlebot sẽ hạn chế thu thập các trang không có giá trị, nội dung mỏng, hoặc trùng lặp, gây lãng phí Crawl Budget.

Tốc độ phản hồi máy chủ chậm

- Thời gian phản hồi máy chủ (Server Response Time): Đây là thời gian mà máy chủ của bạn mất để phản hồi yêu cầu từ Googlebot. Nếu máy chủ phản hồi chậm, Googlebot sẽ tốn nhiều thời gian hơn để tải các trang, làm giảm hiệu quả thu thập dữ liệu.

- Ngân sách bị ảnh hưởng: Máy chủ chậm làm tăng thời gian thu thập dữ liệu cho mỗi trang, khiến Googlebot không thể thu thập nhiều trang trong cùng một Crawl Budget. Google có thể giảm tần suất truy cập nếu website liên tục phản hồi chậm.

- Ảnh hưởng trải nghiệm người dùng: Tốc độ tải trang chậm không chỉ ảnh hưởng đến Googlebot mà còn tác động tiêu cực đến trải nghiệm của người dùng, dẫn đến tỷ lệ thoát cao hơn và giảm tương tác.

Cấu trúc liên kết nội bộ kém

- Trang mồ côi (Orphan pages): Các trang không có bất kỳ liên kết nội bộ nào trỏ đến chúng rất khó để Googlebot khám phá. Chúng gần như “ẩn” đối với trình thu thập.

- Liên kết sâu: Nếu các trang quan trọng nằm quá sâu trong cấu trúc liên kết (cần nhiều nhấp chuột từ trang chủ để đến được), Googlebot có thể khó tiếp cận chúng, đặc biệt là trên các website lớn.

- Liên kết hỏng (Broken links): Các liên kết nội bộ bị hỏng (404 Not Found) làm lãng phí Crawl Budget và tạo ra trải nghiệm người dùng kém.

- Thiếu ngữ cảnh: Các liên kết nội bộ không có anchor text rõ ràng hoặc không nằm trong ngữ cảnh liên quan có thể làm Googlebot khó hiểu mối quan hệ giữa các trang.

Lỗi cấu hình robots.txt, meta robots

robots.txtchặn nhầm: Tệprobots.txtđược sử dụng để hướng dẫn Googlebot không truy cập một số thư mục hoặc tệp nhất định. Tuy nhiên, việc cấu hình sai có thể vô tình chặn Googlebot khỏi các phần quan trọng của website hoặc thậm chí toàn bộ website.- Thẻ

meta robots: Thẻmeta robots(ví dụ:<meta name="robots" content="noindex, nofollow">) đặt trong phần<head>của trang HTML có thể hướng dẫn Googlebot không lập chỉ mục trang (noindex) hoặc không theo dõi các liên kết trên trang (nofollow). Nếu sử dụng sai, nó có thể khiến các trang quan trọng không được lập chỉ mục. - X-Robots-Tag: Đây là một tùy chọn tương tự

meta robotsnhưng được gửi qua HTTP header. Lỗi cấu hình ở đây cũng có thể gây ra vấn đề chặn thu thập và lập chỉ mục.

Website phức tạp

- Rendering (Kết xuất) khó khăn: Các website hiện đại thường sử dụng nhiều JavaScript và AJAX để tải nội dung động. Mặc dù Googlebot đã tiến bộ trong việc kết xuất JavaScript, quá trình này vẫn đòi hỏi nhiều tài nguyên hơn và mất thời gian hơn so với việc thu thập HTML tĩnh.

- Thời gian chờ kết xuất: Googlebot có thể phải chờ một thời gian để JavaScript được thực thi và nội dung hoàn chỉnh được tải, hoặc thậm chí không thể kết xuất đúng cách nếu có lỗi trong mã. Điều này có thể dẫn đến việc bỏ lỡ nội dung quan trọng.

- Yếu tố chặn kết xuất: Các tài nguyên CSS hoặc JavaScript lớn, không tối ưu có thể làm chậm quá trình kết xuất của Googlebot, ảnh hưởng đến khả năng hiểu nội dung của trang.

Thiếu nội dung mới, chất lượng

- Tần suất cập nhật: Nếu website của bạn không thường xuyên cập nhật nội dung mới hoặc cải thiện nội dung hiện có, Googlebot có ít lý do để truy cập thường xuyên.

- Nội dung mỏng/chất lượng thấp: Các trang có nội dung ít, không cung cấp giá trị thực sự cho người dùng, hoặc nội dung được tạo ra tự động có thể bị Google đánh giá thấp. Googlebot sẽ ưu tiên thu thập các trang chất lượng cao.

- Tín hiệu giảm Crawl Budget: Việc thiếu nội dung chất lượng và mới mẻ gửi tín hiệu cho Google rằng website có thể không đáng để đầu tư nhiều Crawl Budget.

Việc xác định và khắc phục các nguyên nhân này là bước thiết yếu để đảm bảo Googlebot thu thập dữ liệu website của bạn một cách hiệu quả nhất.

Hướng dẫn tối ưu hóa cho Googlebot hiệu quả

Để đảm bảo Googlebot thu thập dữ liệu website của bạn một cách hiệu quả, từ đó cải thiện khả năng hiển thị và xếp hạng trên công cụ tìm kiếm, cần áp dụng các chiến lược tối ưu hóa toàn diện.

Tối ưu tốc độ tải trang

Tốc độ tải trang là yếu tố quan trọng hàng đầu ảnh hưởng đến cả Googlebot và trải nghiệm người dùng.

- Nén hình ảnh và tài nguyên:

- Sử dụng định dạng hình ảnh tối ưu (WebP) và nén kích thước tệp mà không làm giảm chất lượng.

- Nén các tệp CSS, JavaScript và HTML.

- Giảm thiểu thời gian phản hồi máy chủ:

- Chọn nhà cung cấp hosting chất lượng cao.

- Sử dụng CDN (Content Delivery Network) để phân phối nội dung từ máy chủ gần người dùng nhất.

- Tối ưu hóa mã nguồn phía máy chủ (ví dụ: PHP, cơ sở dữ liệu).

- Tối ưu hóa CSS và JavaScript:

- Gộp và rút gọn (minify) các tệp CSS/JS.

- Tải bất đồng bộ (async) hoặc trì hoãn (defer) các tệp JS không quan trọng để nội dung chính được hiển thị trước.

- Loại bỏ CSS và JS không sử dụng.

- Sử dụng bộ nhớ đệm (Caching):

- Áp dụng caching trên trình duyệt và máy chủ để lưu trữ các tài nguyên tĩnh, giảm thời gian tải cho các lần truy cập sau.

Xây dựng cấu trúc liên kết nội bộ logic

Một cấu trúc liên kết nội bộ chặt chẽ và có tổ chức giúp Googlebot dễ dàng khám phá tất cả các trang quan trọng và hiểu được hệ thống phân cấp nội dung của bạn.

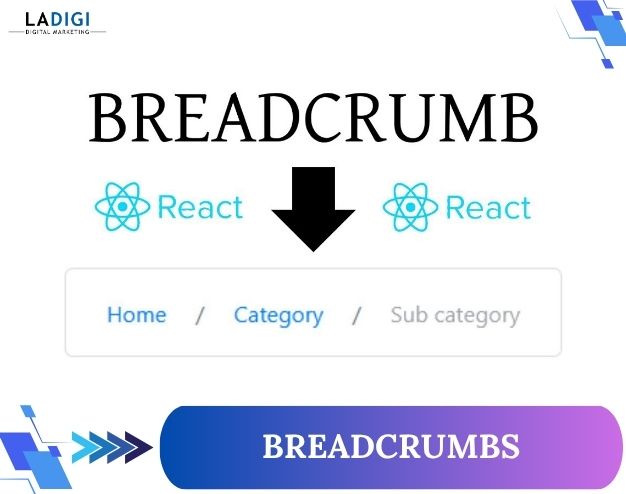

- Tạo cấu trúc phân cấp rõ ràng:

- Thiết kế website với cấu trúc silo hoặc dạng cây, nơi các trang chính (category) liên kết đến các trang phụ (sub-category) và các bài viết cụ thể.

- Đảm bảo các trang quan trọng nhất có thể truy cập được trong 2-3 nhấp chuột từ trang chủ.

- Sử dụng anchor text mô tả:

- Các liên kết nội bộ nên sử dụng anchor text chứa từ khóa hoặc mô tả rõ ràng về nội dung của trang đích, giúp Googlebot và người dùng hiểu ngữ cảnh.

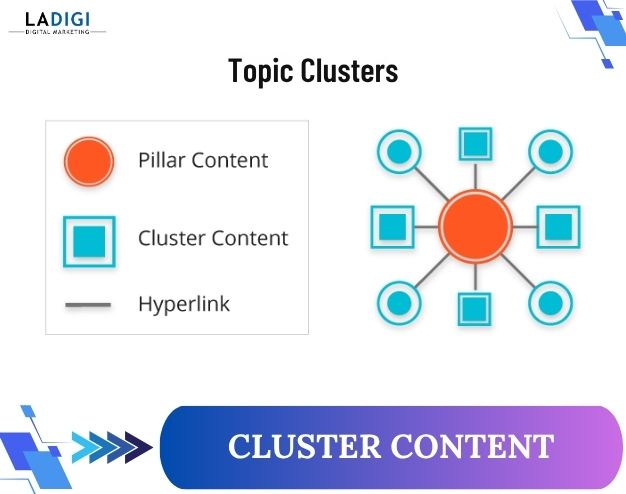

- Liên kết chéo có chiến lược:

- Liên kết các bài viết liên quan với nhau để tạo ra một mạng lưới thông tin, tăng cường sự liên kết ngữ nghĩa giữa các thực thể và phân phối PageRank.

- Tránh các trang mồ côi:

- Đảm bảo mọi trang có giá trị đều có ít nhất một liên kết nội bộ trỏ đến nó.

Sử dụng Sitemap hiệu quả

Sitemap là một tệp cung cấp danh sách tất cả các trang và tệp quan trọng trên website của bạn, giúp Googlebot tìm thấy chúng dễ dàng hơn.

- Tạo XML Sitemap chính xác:

- Sử dụng công cụ hoặc plugin để tạo XML Sitemap tự động và đảm bảo nó được cập nhật khi có trang mới hoặc thay đổi.

- Chỉ bao gồm các URL canonical (phiên bản chính thức của trang) và các trang bạn muốn Googlebot lập chỉ mục.

- Gửi Sitemap qua Google Search Console:

- Sau khi tạo, hãy gửi XML Sitemap của bạn thông qua phần “Sitemaps” trong Google Search Console để Googlebot biết vị trí và tần suất cập nhật.

- Sử dụng sitemap cho các loại nội dung khác:

- Bên cạnh HTML, bạn có thể tạo sitemap riêng cho hình ảnh (image sitemap), video (video sitemap) hoặc tin tức (news sitemap) để Googlebot thu thập các loại nội dung này hiệu quả hơn.

Đảm bảo website thân thiện di động

Với lập chỉ mục ưu tiên di động (mobile-first indexing), phiên bản di động của website là phiên bản chính mà Googlebot sử dụng để thu thập dữ thập và lập chỉ mục.

- Thiết kế đáp ứng (Responsive Design):

- Sử dụng thiết kế responsive để website tự động điều chỉnh bố cục và nội dung cho phù hợp với kích thước màn hình của mọi thiết bị.

- Kiểm tra tính thân thiện di động:

- Sử dụng công cụ Kiểm tra tính thân thiện với thiết bị di động của Google hoặc báo cáo “Khả năng sử dụng trên thiết bị di động” trong Google Search Console để xác định và khắc phục các vấn đề.

- Đảm bảo nội dung nhất quán:

- Nội dung, liên kết, hình ảnh và dữ liệu có cấu trúc phải giống nhau trên cả phiên bản di động và máy tính để bàn.

Sử dụng dữ liệu có cấu trúc

Schema Markup là một dạng mã ngữ nghĩa giúp các công cụ tìm kiếm hiểu rõ hơn về nội dung của trang web.

- Triển khai Schema phù hợp:

- Xác định loại nội dung của bạn (ví dụ: bài viết, sản phẩm, đánh giá, sự kiện, công thức) và triển khai Schema Markup phù hợp.

- Sử dụng các công cụ như Schema.org, Google’s Structured Data Markup Helper.

- Tăng cường khả năng hiểu của Googlebot:

- Schema giúp Googlebot dễ dàng nhận diện các thực thể, thuộc tính và mối quan hệ trên trang, cải thiện độ chính xác trong việc lập chỉ mục.

- Hiển thị Rich Results:

- Dữ liệu có cấu trúc có thể giúp trang của bạn đủ điều kiện hiển thị dưới dạng Rich Results (kết quả nhiều định dạng) trong SERP, như hộp đánh giá, giá sản phẩm, công thức nấu ăn, giúp tăng tỷ lệ nhấp (CTR).

Kiểm soát robots.txt và thẻ meta robots

Đây là các công cụ mạnh mẽ để hướng dẫn Googlebot, nhưng cần được sử dụng cẩn thận.

- Cấu hình robots.txt chính xác:

- Sử dụng

robots.txtđể chặn các trang không quan trọng (ví dụ: trang admin, trang tìm kiếm nội bộ, trang giỏ hàng tạm thời) nhằm tiết kiệm Crawl Budget. - Đảm bảo không chặn nhầm các trang quan trọng mà bạn muốn Google lập chỉ mục.

- Kiểm tra tệp

robots.txtbằng công cụ Trình kiểm tra robots.txt trong Google Search Console.

- Sử dụng

- Sử dụng thẻ

meta robots(noindex,nofollow):noindex: Dùng cho các trang bạn muốn Googlebot thu thập nhưng không muốn lập chỉ mục (ví dụ: trang cám ơn, chính sách bảo mật không cần hiển thị trên tìm kiếm).nofollow: Dùng cho các liên kết bạn không muốn Googlebot theo dõi hoặc truyền PageRank (ví dụ: liên kết quảng cáo, liên kết đến các trang không đáng tin cậy).- Lưu ý:

noindextrongrobots.txtkhông được hỗ trợ chính thức. Luôn sử dụngmeta robotshoặc X-Robots-Tag chonoindex.

Bằng cách áp dụng các hướng dẫn này, bạn không chỉ giúp Googlebot làm việc hiệu quả hơn mà còn cải thiện đáng kể trải nghiệm người dùng và hiệu suất SEO tổng thể của website.

Các vấn đề thường gặp và cách khắc phục

Mặc dù đã tối ưu hóa, các website vẫn có thể gặp phải các vấn đề với Googlebot. Việc nhận diện và khắc phục chúng kịp thời là rất quan trọng để duy trì thứ hạng và khả năng hiển thị.

Lỗi thu thập dữ liệu

Lỗi thu thập dữ liệu là các vấn đề mà Googlebot gặp phải khi cố gắng truy cập hoặc thu thập nội dung trên website của bạn.

- Loại lỗi phổ biến:

- Lỗi 4xx (Client errors): Ví dụ: 404 Not Found (trang không tồn tại), 403 Forbidden (truy cập bị cấm).

- Lỗi 5xx (Server errors): Ví dụ: 500 Internal Server Error (lỗi máy chủ nội bộ), 503 Service Unavailable (máy chủ không hoạt động).

- Tác động: Các lỗi này làm lãng phí Crawl Budget, có thể dẫn đến việc Google loại bỏ các trang bị lỗi khỏi chỉ mục hoặc giảm tần suất thu thập dữ liệu cho toàn bộ website.

- Cách khắc phục:

- Kiểm tra trong Google Search Console: Sử dụng báo cáo “Lỗi thu thập dữ liệu” hoặc “Trạng thái lập chỉ mục” (Index Status) để xem danh sách các URL bị lỗi.

- Sửa lỗi 404:

- Nếu trang bị xóa vĩnh viễn, hãy thiết lập chuyển hướng 301 đến một trang liên quan.

- Nếu trang bị xóa tạm thời, xem xét chuyển hướng 302 hoặc khắc phục vấn đề.

- Nếu trang không tồn tại và không cần thiết, để nguyên lỗi 404 là chấp nhận được, nhưng cần đảm bảo nó không phải là một trang quan trọng.

- Khắc phục lỗi máy chủ (5xx): Liên hệ với nhà cung cấp hosting để kiểm tra và sửa lỗi máy chủ. Tối ưu hóa hiệu suất máy chủ để tránh quá tải.

Cách xác minh Googlebot

Đôi khi, bạn có thể thấy lưu lượng truy cập đáng ngờ với user-agent giống Googlebot. Việc xác minh Googlebot là cần thiết để đảm bảo đó là bot hợp pháp và không phải bot độc hại.

- Kiểm tra User-Agent: Googlebot sẽ sử dụng các chuỗi user-agent như

Mozilla/5.0 (compatible; Googlebot/2.1; +http://www.google.com/bot.html)hoặcMozilla/5.0 (Linux; Android 6.0.1; Nexus 5X Build/MMB29P) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/W.X.Y.Z Mobile Safari/537.36 (compatible; Googlebot/2.1; +http://www.google.com/bot.html). - Thực hiện Reverse DNS Lookup: Đây là phương pháp đáng tin cậy nhất.

- Lấy địa chỉ IP của trình thu thập từ nhật ký máy chủ (server logs).

- Thực hiện reverse DNS lookup trên địa chỉ IP đó. Tên miền phải là

googlebot.comhoặcgoogle.com. - Thực hiện forward DNS lookup trên tên miền thu được ở bước 2. Địa chỉ IP phải khớp với địa chỉ IP ban đầu.

- Lưu ý: Không tin tưởng hoàn toàn vào chuỗi user-agent vì nó có thể bị giả mạo.

Sử dụng Google Search Console hiệu quả

Google Search Console (GSC) là công cụ miễn phí và vô giá từ Google để theo dõi hiệu suất, thu thập dữ liệu và lập chỉ mục của website.

- Theo dõi báo cáo bao phủ chỉ mục (Index Coverage):

- Kiểm tra số lượng trang được lập chỉ mục, các trang bị loại trừ và lý do loại trừ (ví dụ: bị chặn bởi

robots.txt, lỗinoindex, trùng lặp). - Sử dụng báo cáo này để xác định các vấn đề về lập chỉ mục.

- Kiểm tra số lượng trang được lập chỉ mục, các trang bị loại trừ và lý do loại trừ (ví dụ: bị chặn bởi

- Sử dụng công cụ Kiểm tra URL (URL Inspection Tool):

- Kiểm tra trạng thái lập chỉ mục của một URL cụ thể.

- Xem phiên bản trang mà Googlebot đã thu thập và kết xuất (HTML, screenshot, JavaScript console logs).

- Yêu cầu Google lập chỉ mục lại một URL sau khi đã thực hiện thay đổi.

- Kiểm tra Sitemap:

- Đảm bảo Sitemap của bạn được gửi thành công và không có lỗi.

- Xem số lượng URL đã gửi và số lượng đã được lập chỉ mục.

- Báo cáo Crawl Stats (Thống kê thu thập dữ liệu):

- Cung cấp thông tin về hoạt động của Googlebot trên website của bạn, bao gồm số lượng yêu cầu thu thập dữ liệu, tổng dung lượng tải xuống và thời gian phản hồi trung bình.

- Giúp bạn hiểu Crawl Budget của mình đang được sử dụng như thế nào.

Khắc phục lỗi robots.txt

Lỗi cấu hình tệp robots.txt có thể ngăn Googlebot truy cập các phần quan trọng của website.

- Sử dụng Trình kiểm tra robots.txt trong GSC:

- Công cụ này cho phép bạn kiểm tra cú pháp của tệp

robots.txtvà xác định xem một URL cụ thể có bị chặn bởirobots.txthay không.

- Công cụ này cho phép bạn kiểm tra cú pháp của tệp

- Kiểm tra cú pháp:

- Đảm bảo

Disallow: /không được sử dụng nhầm nếu bạn muốn toàn bộ website được lập chỉ mục. - Kiểm tra lỗi chính tả trong các lệnh

User-agent,Disallow,Allow.

- Đảm bảo

- Chỉ chặn các tài nguyên không cần thiết:

- Chặn các trang quản trị, các tệp tạm thời, các thư mục chỉ chứa tài nguyên nội bộ. Không chặn các tệp CSS, JS quan trọng nếu chúng cần thiết cho việc kết xuất trang.

Giải quyết vấn đề Crawl Budget

Nếu Googlebot thu thập dữ liệu quá chậm do hạn chế Crawl Budget, bạn cần tối ưu hóa cách nó được sử dụng.

- Loại bỏ các trang không cần thiết:

- Sử dụng

noindexcho các trang có nội dung trùng lặp, nội dung mỏng, trang kết quả tìm kiếm nội bộ, trang giỏ hàng trống, trang chính sách không quan trọng. - Xóa hoàn toàn các trang lỗi 404 không còn giá trị.

- Sử dụng

- Tối ưu hóa tốc độ tải trang:

- Như đã đề cập ở trên, tốc độ tải nhanh giúp Googlebot thu thập nhiều trang hơn trong cùng một khoảng thời gian.

- Nâng cao chất lượng nội dung:

- Tập trung vào việc tạo ra nội dung chất lượng cao, độc đáo và hữu ích. Các trang có giá trị cao thường được ưu tiên thu thập hơn.

- Xây dựng cấu trúc liên kết nội bộ mạnh mẽ:

- Đảm bảo Googlebot có thể dễ dàng tiếp cận tất cả các trang quan trọng thông qua các liên kết nội bộ.

- Cập nhật Sitemap thường xuyên:

- Đảm bảo Sitemap của bạn chỉ chứa các URL quan trọng và được cập nhật mỗi khi có thay đổi lớn.

Bằng cách chủ động theo dõi và khắc phục các vấn đề này, bạn có thể đảm bảo Googlebot hoạt động hiệu quả nhất trên website của mình, góp phần vào sự thành công của chiến lược SEO.

Kết bài:

Việc hiểu rõ Googlebot là gì và cơ chế hoạt động của nó không chỉ là kiến thức nền tảng mà còn là yếu tố then chốt quyết định sự thành công của mọi chiến dịch SEO. Từ việc khám phá và lập chỉ mục, Googlebot đóng vai trò trung tâm trong việc đưa nội dung của bạn đến với người dùng tìm kiếm. LADIGI Agency nhận thấy rằng việc tối ưu hóa website cho Googlebot, thông qua việc cải thiện tốc độ tải trang, xây dựng cấu trúc liên kết nội bộ vững chắc, sử dụng Sitemap hiệu quả, đảm bảo tính thân thiện di động, triển khai dữ liệu có cấu trúc và kiểm soát robots.txt, là những bước không thể thiếu để nâng cao khả năng hiển thị và thứ hạng. Bằng cách giải quyết các vấn đề thường gặp như lỗi thu thập dữ liệu và tối ưu hóa Crawl Budget, bạn có thể đảm bảo website của mình luôn được Googlebot “quan tâm” và xử lý một cách hiệu quả nhất.

Nếu website của bạn đang gặp khó khăn trong việc hiển thị trên Google hoặc cần một chiến lược tối ưu hóa toàn diện cho Googlebot, hãy liên hệ với LADIGI Agency để được tư vấn dịch vụ SEO chuyên nghiệp.